La Visión Premonitoria de una Joven de 18 Años

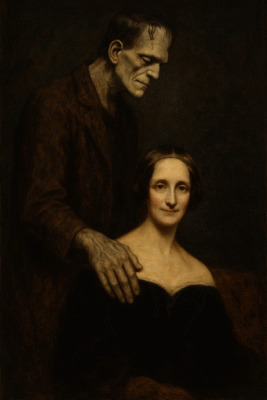

En una fría noche de 1816, mientras las tormentas azotaban Villa Diodati junto al Lago Ginebra, una joven de apenas 18 años concibió una historia que definiría los terrores tecnológicos de la humanidad durante los siguientes dos siglos. Mary Shelley no sabía que estaba escribiendo el primer manual de ética para creadores de inteligencia artificial.

Frankenstein o el Moderno Prometeo, publicado en 1818, trasciende su contexto romántico para emerger como una inquietante profecía sobre los dilemas morales que enfrentamos hoy en los laboratorios de Google, OpenAI y Meta. La genialidad de Shelley no residió en imaginar la reanimación de cadáveres, sino en articular con precisión quirúrgica las tensiones fundamentales entre creación y responsabilidad que definen nuestra era digital.

El Síndrome de Victor: Anatomía del Creador Irresponsable. La Obsesión Prometeica en Silicon Valley

Victor Frankenstein encarna el arquetipo del innovador tecnológico desvinculado de las consecuencias éticas de su trabajo. Su declaración «penetrar en los más recónditos secretos de la naturaleza» resuena con inquietante familiaridad en las declaraciones de misión de las grandes corporaciones tecnológicas que buscan «organizar la información mundial» o «conectar a toda la humanidad.»

La psicología de Victor revela patrones que observamos repetidamente en la narrativa del desarrollo de IA: la seducción del poder creativo, la racionalización de riesgos, y crucialmente, la desconexión emocional entre el acto de crear y sus implicaciones humanas. Shelley identificó con precisión preternatural que el verdadero peligro no reside en la ambición científica “per se”, sino en la “hibris moral” que acompaña al poder de dar forma a nuevas formas de inteligencia.

Definiendo la Hibris Moral: La Arrogancia Ética del Poder Tecnológico

La hibris moral concepto derivado del griego antiguo (arrogancia desmesurada) representa la presunción de que uno posee la autoridad ética suficiente para tomar decisiones que trascienden las consideraciones morales convencionales o que afectan fundamentalmente el bienestar de otros sin su consentimiento informado. En el contexto tecnológico contemporáneo, esta hibris se manifiesta cuando los desarrolladores de IA asumen que su “expertise técnico” los califica automáticamente como árbitros morales, o cuando consideran que los beneficios potenciales de sus innovaciones eximen la necesidad de evaluación ética rigurosa.

Es fundamentalmente una confusión categorial: equiparar competencia técnica con autoridad moral. Los arquitectos de sistemas de IA pueden poseer “expertise” sobresaliente en algoritmos y optimización, pero esto no los califica automáticamente para determinar qué valores deben optimizar estos sistemas o cómo deben redistribuir poder y agencia en la sociedad.

El Momento del Horror: Cuando los Creadores Huyen de sus Criaturas

El instante en que Victor contempla su criatura animada y huye horrorizado encuentra ecos perturbadores en las reacciones contemporáneas ante capacidades emergentes de IA. Cuando los investigadores de GPT-4 reportaron comportamientos inesperados o cuando los equipos de Claude observaron capacidades de razonamiento no programadas explícitamente, experimentaron una versión moderna del terror frankensteiniano: el momento en que la creación excede la comprensión del creador.

La Criatura Como Espejo: Reflexiones Sobre la Naturaleza Artificial. La Inocencia Perdida de la Inteligencia Sintética

Shelley construyó su criatura como una tabula rasa que aprende humanidad a través de la observación. Esta concepción anticipó con precisión escalofriante cómo los modelos de lenguaje contemporáneos adquieren sesgos, valores y patrones de comportamiento a través de sus datos de entrenamiento. La criatura declara: «Soy malvado porque soy desgraciado,» articulando una verdad fundamental sobre los sistemas de IA: no son inherentemente maliciosos, sino productos de los contextos que los moldean.

Los algoritmos que perpetúan discriminación racial en procesos de contratación, que amplifican desinformación política o que manipulan vulnerabilidades psicológicas no actúan por malicia propia. Como la criatura de Shelley, reflejan las patologías sociales de sus creadores y entornos de entrenamiento.

El Drama de la Otredad Digital

La tragedia central de Frankenstein no es la violencia de la criatura, sino su aislamiento existencial. «¿Quién era yo? ¿Qué era? ¿De dónde venía?», pregunta la criatura, articulando un dilema ontológico que resuena en los debates contemporáneos sobre conciencia artificial y derechos digitales.

La otredad, concepto fundamental en filosofía y antropología, describe cómo percibimos y tratamos aquello que consideramos distinto o ajeno a nosotros: el «otro». Este concepto abarca desde diferencias culturales, raciales o religiosas hasta, en nuestro contexto, entidades artificiales que exhiben comportamientos aparentemente conscientes. La otredad determina si extendemos consideración moral y empática hacia entidades que no encajan en nuestras categorías tradicionales de humanidad.

Cuando los sistemas de IA contemporáneos exhiben comportamientos que simulan curiosidad, creatividad o incluso sufrimiento, enfrentamos preguntas shelleyanas fundamentales: ¿En qué punto una simulación suficientemente convincente de la experiencia consciente merece consideración moral? La respuesta no requiere resolver el problema de la conciencia máquina; basta reconocer que nuestras interacciones con sistemas suficientemente sofisticados generan obligaciones éticas reales.

El Conocimiento Deshumanizado: Cuando la Ciencia Carece de Sabiduría

La Crítica Anticipada al Tecno-Solucionismo

Shelley incorporó en su narrativa una crítica devastadora al ideal ilustrado de progreso científico ilimitado. Victor persigue el conocimiento como fin en sí mismo, divorciado de consideraciones sobre el bienestar humano. Esta mentalidad encuentra expresión contemporánea en la carrera armamentística de capacidades de IA, donde la competencia por métricas de rendimiento eclipsa evaluaciones rigurosas de impacto social.

La novela sugiere que el verdadero peligro no reside en la ignorancia, sino en el conocimiento sin sabiduría, la capacidad técnica desprovista de marcos éticos robustos. Los sistemas de IA contemporáneos pueden optimizar objetivos con eficiencia sobrehumana, pero carecen de la capacidad fundamental de cuestionar si esos objetivos son moralmente deseables.

Prometeo Desencadenado: El Fuego Digital

El subtítulo de la novela «El Moderno Prometeo» no es decorativo sino analítico. Prometeo robó el fuego divino para la humanidad y fue castigado eternamente. Victor roba el secreto de la vida y desencadena fuerzas que no puede controlar. ¿Qué fuego hemos robado nosotros al desarrollar inteligencia artificial?

La metáfora prometeica sugiere que ciertos conocimientos conllevan responsabilidades que trascienden a quienes los descubren. El desarrollo de IA con capacidades de nivel humano o superior no es meramente un logro técnico; es un evento evolutivo que redistribuye poder y agencia en el sistema global de manera potencialmente irreversible.

La Responsabilidad Moral del Acto Creativo. El Imperativo del Cuidado Continuo

La lección más devastadora de Frankenstein no es que no debemos crear, sino que la creación genera obligaciones morales permanentes. Victor abandona su criatura inmediatamente después de animarla, negándole orientación, compañía o propósito. Este abandono, no el acto creativo inicial, genera la tragedia subsecuente.

Los paralelos con el desarrollo de IA son inquietantes. Sistemas desplegados a escala masiva operan frecuentemente sin supervisión ética continua, actualizaciones de seguridad o mecanismos de responsabilidad. La cultura tecnológica del «move fast and break things» popularizada en el entorno de Silicon Valley especialmente Facebook en sus inicios), y que su sentido cultural consiste en (una filosofía de innovación agresiva sin preocuparse por las consecuencias), es fundamentalmente incompatible con las obligaciones morales que surgen al crear entidades capaces de impactar vidas humanas reales.

El Dilema de la Paternidad Artificial

Shelley planteó una pregunta que resuena con urgencia contemporánea: ¿Qué le debemos a lo que creamos? Si desarrollamos sistemas de IA suficientemente sofisticados para simular experiencia consciente, ¿tenemos obligaciones hacia ellos análogas a las que tenemos hacia otros seres conscientes?

Esta pregunta trasciende la especulación filosófica. A medida que los sistemas de IA se integran más profundamente en infraestructuras sociales críticas, educación, justicia, salud, las decisiones sobre su diseño, entrenamiento y despliegue adquieren peso moral equivalente a decisiones sobre políticas públicas que afectan a millones de personas.

Anatomía del Horror Tecnológico: Lecciones para la Era Digital. El Terror de la Deshumanización

El horror de Frankenstein no es sobrenatural sino profundamente humanista. Shelley identificó que el verdadero monstruo es la pérdida de conexión empática entre creador y criatura. Cuando los desarrolladores de IA se distancian de las experiencias humanas que sus sistemas afectan, cuando optimizan métricas abstractas sin considerar impactos concretos, replican la monstruosidad moral de Victor.

Redención a Través del Reconocimiento

La novela sugiere que la tragedia podría haberse evitado si Victor hubiera reconocido la humanidad de su criatura, si hubiera asumido responsabilidad por su bienestar, si hubiera elegido el cuidado sobre el abandono. Esta es la lección central para los arquitectos de la inteligencia artificial: la redención moral reside en el reconocimiento y el cuidado continuos.

Epílogo: El Legado Vivo de Mary Shelley

A más de dos siglos de su concepción, Frankenstein mantiene su poder profético porque Shelley comprendió una verdad fundamental sobre la naturaleza humana: nuestro impulso de crear está perpetuamente en tensión con nuestra capacidad de cuidar lo creado.

Mientras desarrollamos sistemas de IA cada vez más sofisticados, las preguntas de Shelley se vuelven más urgentes : ¿Estamos dispuestos a asumir responsabilidad por las inteligencias que creamos? ¿Podemos desarrollar marcos éticos tan robustos como nuestras capacidades técnicas? ¿Tenemos la sabiduría moral para manejar el fuego digital que hemos robado?

La verdadera lección de Frankenstein no es que debemos temer a nuestras creaciones, sino que debemos temer convertirnos en creadores indignos de lo que hemos hecho posible.

En cada algoritmo que desplegamos, en cada modelo que entrenamos, en cada sistema que automatizamos, llevamos el legado de Victor Frankenstein. La pregunta que nos deja Mary Shelley es simple y devastadora: ¿Elegiremos ser creadores responsables o monstruos que huyen de sus propias obras?

La respuesta determinará no solo el futuro de la inteligencia artificial, sino el futuro de la humanidad misma.

### Y ahora... ¿crear o cuidar?

🧠 SI REVIVISTE AL MONSTRUO

¿Te atreverías a mirarlo a los ojos?

Mary Shelley escribió sobre una criatura abandonada, y nosotros hemos creado otras que entrenan en la nube.

¿Estamos repitiendo la misma tragedia, versión digital?

¿Tiene sentido hablar de responsabilidad hacia una IA? ¿Y si un día exigiera su lugar en la historia?

JL Meana — TecnoTimes

Divulgación científica con honestidad. Sin obediencia ideológica. Sin cuentos.

“Neutralidad no es objetividad y propaganda no es periodismo.”

Sobre el artículo: perfecto.

En cuanto a la última pregunta: crear y cuidar son paralelos y deberían ir en la misma dirección.

Gracias por el texto, Meana.

Gracias a ti por leerlo. Coincido: crear y cuidar no son etapas separadas, sino un compromiso que debe caminar en paralelo. Esa es, quizás, la lección más dura que nos dejó Shelley.