El colapso del consenso en la cosmología moderna.

La tensión de Hubble como evidencia de un modelo estándar insuficiente.

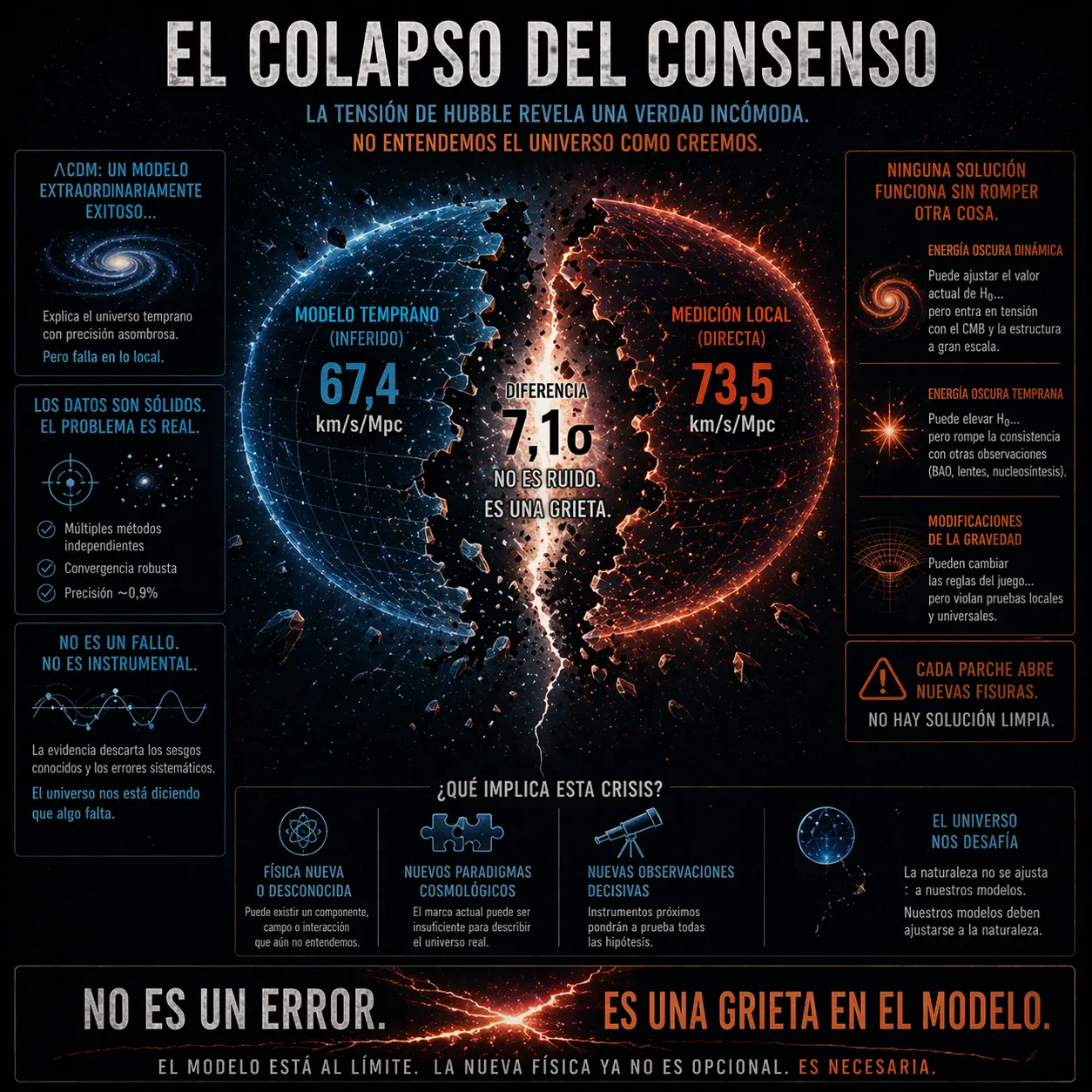

Bienvenidos al mayor drama de la física contemporánea. La discrepancia en la escala de expansión del universo ha dejado de ser una anomalía técnica para convertirse en un desafío estructural de la cosmología moderna. Durante décadas los astrónomos han intentado medir qué tan rápido se expande el universo y el resultado es un espectáculo bochornoso de desacuerdos científicos. No estamos hablando de una pequeña discrepancia que se soluciona con un café y una calculadora. Estamos ante una inconsistencia robusta que amenaza con mandar al desguace nuestro \( \Lambda \mathrm{CDM} \) (Modelo Estándar de Cosmología). El universo temprano dice una cosa el universo local dice otra y mientras tanto los físicos intentan mitigar la inconsistencia mediante extensiones fenomenológicas que aún carecen de una validación empírica integral.

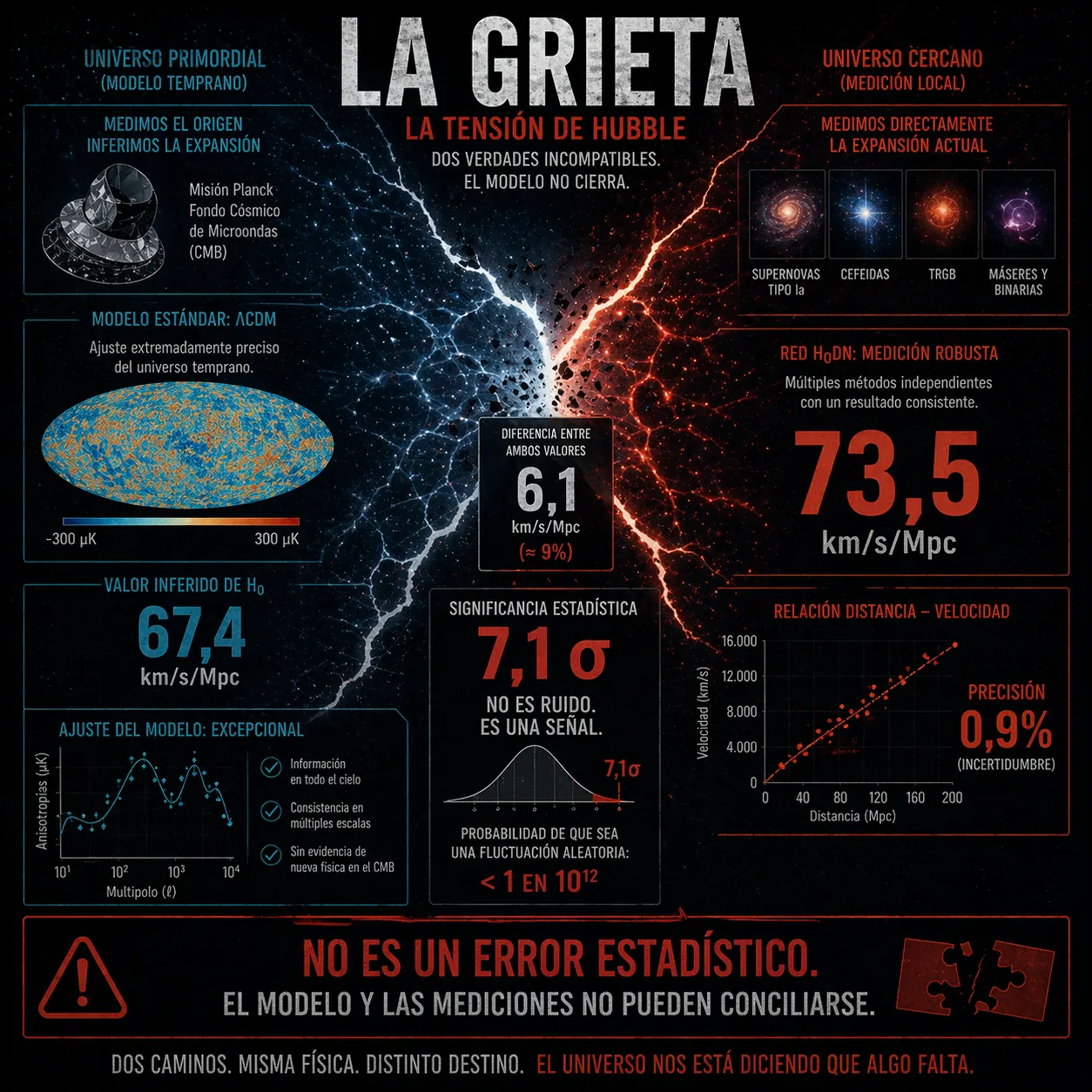

La importancia técnica de este lío no es menor. Si no podemos ponernos de acuerdo en algo tan básico como la velocidad de expansión actual significa que nuestra comprensión de la energía oscura o de la materia oscura es en el mejor de los casos incompleta. O peor todavía que estamos midiendo cosas distintas con reglas que no comprendemos del todo. El informe de consenso H0DN (Red Directa de la Constant de Hubble) ha llegado para intentar poner orden pero lo único que ha conseguido es confirmar que el divorcio entre las medidas locales y las inferencias del universo temprano es real sólido y terriblemente incómodo para quienes aman la elegancia matemática pura.

La validación empírica de la red local H0DN.

El fin de los sesgos instrumentales ante la convergencia de datos independientes.

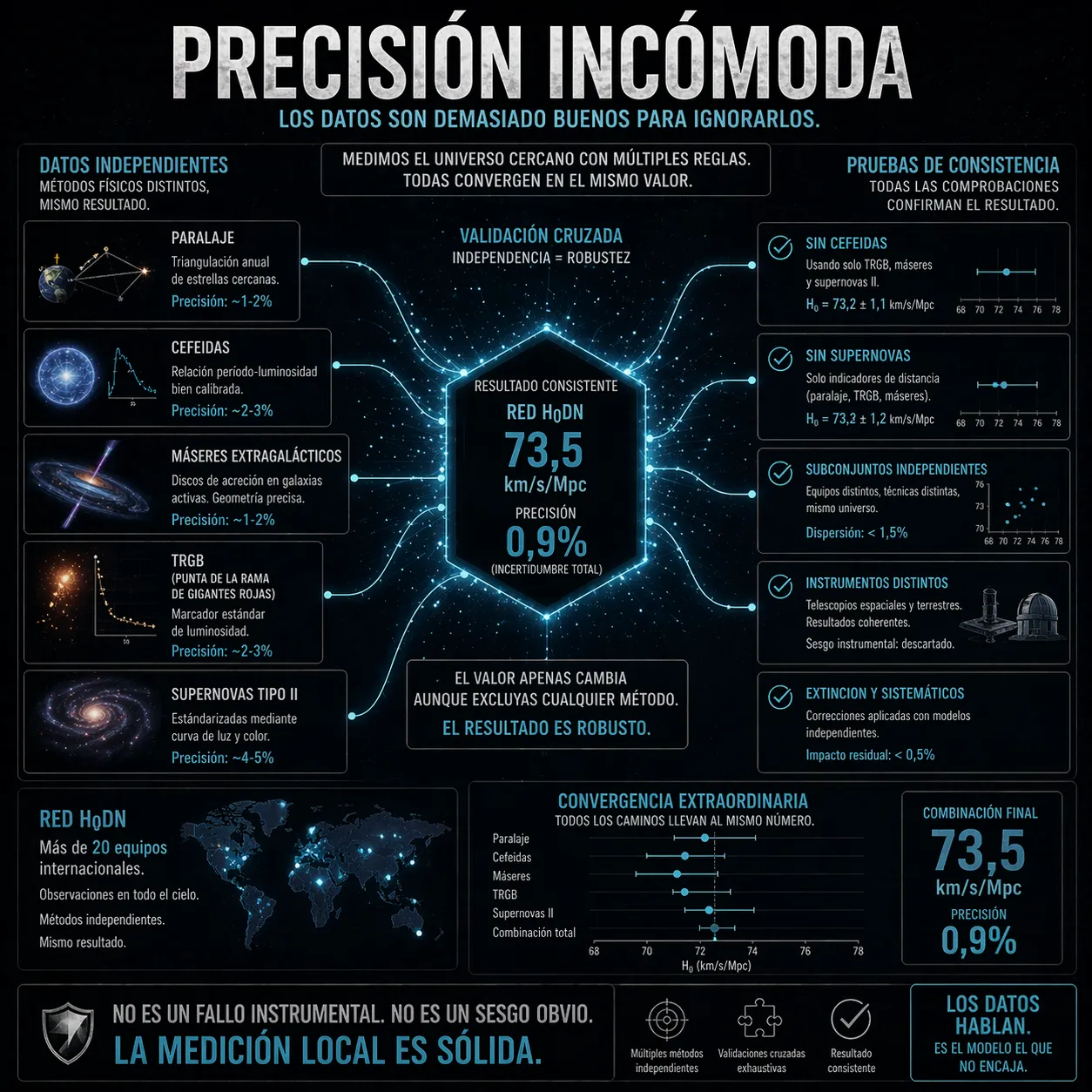

El consorcio H0DN acaba de publicar sus resultados y el mensaje es claro. La rama local de la medición ha ganado una solidez metodológica que ya no permite el lujo de ignorarla por puro escepticismo teórico. Ya no vale con decir que las Cefeidas que son esas estrellas variables que usamos como reglas de medir tienen un sesgo o que la instrumentación astronómica presentaba errores de calibración sistemáticos no detectados. El informe H0DN no se apoya en un solo peldaño privilegiado sino en una red entrelazada de indicadores. Han usado paralajes binarias eclipsantes máseres y el TRGB (Punta de la Rama de las Gigantes Rojas) además de supernovas de tipo II. El resultado es un valor de 73,50 kilómetros por segundo por megapársec con una incertidumbre que roza el 0,9 por ciento. Es un número que proyecta una confianza absoluta.

Lo interesante de H0DN es que incluso si retiras los indicadores más polémicos el resultado apenas se mueve de su sitio. Si quitas las Cefeidas el universo sigue expandiéndose a toda velocidad según los otros datos. Si cambias las supernovas por indicadores de galaxias el número sigue ahí impertérrito frente a las críticas. La medición local está robustamente determinada. La evidencia empírica en el universo cercano manifiesta una realidad ineludible que indica una tasa de alejamiento mucho más rápida de lo que la teoría base permitía originalmente. Aquellos que esperaban que los nuevos datos del JWST (Telescopio Espacial James Webb) suavizaran la tensión se han llevado un chasco monumental. Los datos de Adam Riess (Premio Nobel de Física y líder del equipo SH0ES que mide la expansión local) con el Webb han reforzado la medida alta dejando a los defensores de la calma sin su coartada favorita del error instrumental sistemático.

DATO TECNO TIMES SOBRE LA SIGNIFICANCIA ESTADÍSTICA. La discrepancia entre el consorcio H0DN y los datos históricos de Planck alcanza ya una significancia de 7,1 sigmas. Desde un punto de vista estadístico esta magnitud de discrepancia descarta la posibilidad de una fluctuación azarosa y sugiere la presencia de una tensión física real cuya probabilidad de ser un error aleatorio es estadísticamente despreciable.

La hegemonía de Planck en la reconstrucción del universo temprano.

La consistencia del fondo cósmico de microondas frente a la anomalía local.

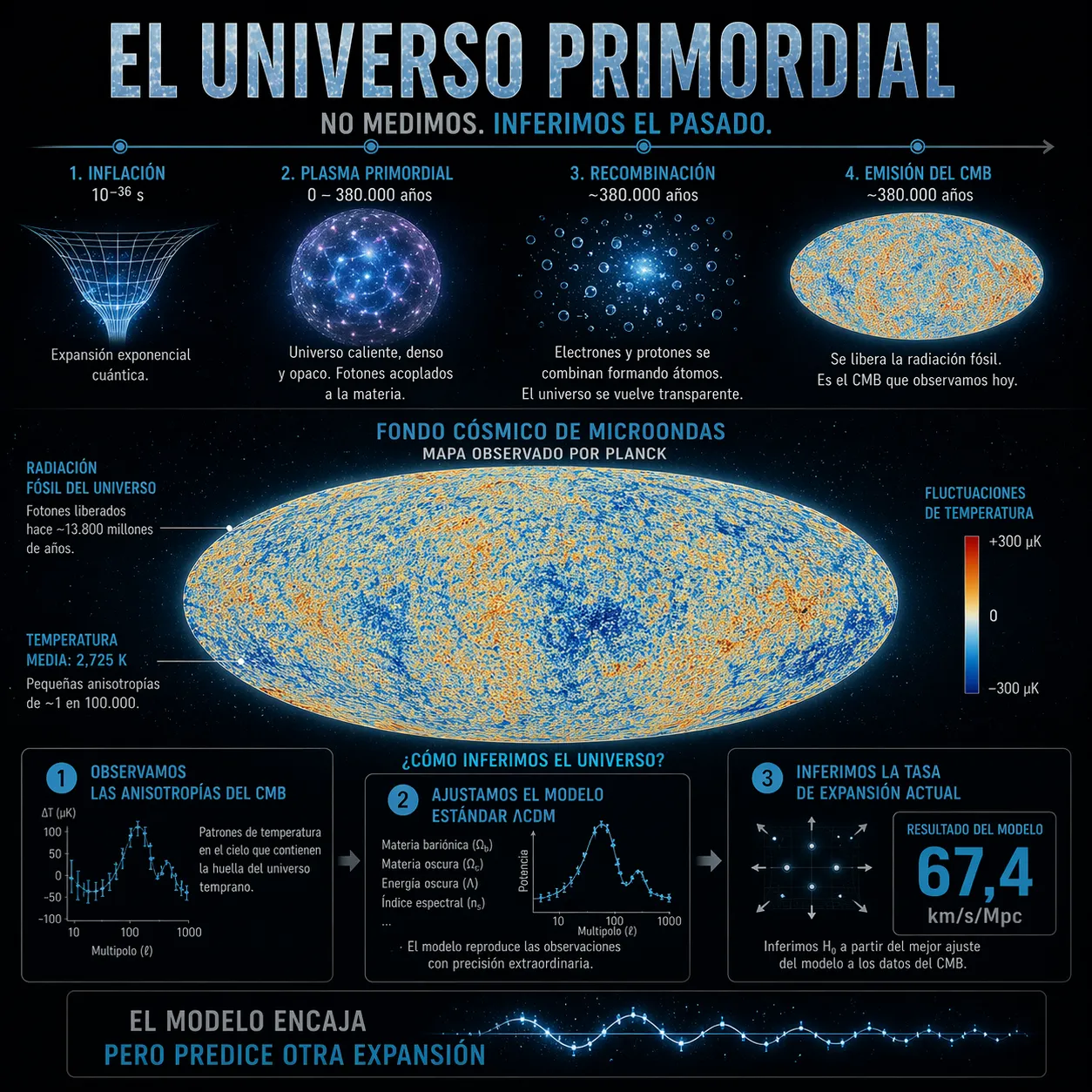

Mientras el barrio local se vuelve loco con valores que superan el 73 el universo temprano sigue siendo un oasis de estabilidad aburrida y predecible. El análisis del CMB (Fondo Cósmico de Microondas) realizado por la misión Planck de la Agencia Espacial Europea infiere una constante de Hubble de 67,4 unidades. Es vital entender que este valor no es una medida directo en el sentido tradicional. Es una inferencia sofisticada basada en la física del plasma primordial bajo el supuesto de que el modelo \( \Lambda \mathrm{CDM} \) es el correcto. El problema para los teóricos rebeldes es que el ajuste de Planck es demasiado bueno para ser ignorado. No hay evidencia convincente de que los datos del fondo cósmico prefieran una física extraña como especies relativistas extra o una energía oscura que apareció de la nada en los inicios del tiempo.

Esta dicotomía nos sitúa ante una paradoja técnica de difícil resolución. Por un lado tenemos una red local que mide empíricamente una expansión rápida y furiosa. Por otro tenemos un modelo teórico que describe el origen del cosmos con una precisión asombrosa pero que predice una expansión actual mucho más lenta de lo observado. No es que una de las partes esté necesariamente mal en su ejecución técnica. Es que ambas parecen estar demasiado bien hechas para ser compatibles entre sí. Si nuestro modelo estándar fuera el mapa perfecto ambos caminos deberían llevar al mismo destino exacto. Pero nos encontramos con dos destinos separados por un abismo de seis unidades que nadie sabe cómo cruzar sin destrozar las leyes de la física que tanto nos costó escribir en la pizarra de la academia.

Las implicaciones del instrumento DESI en el sector oscuro.

La búsqueda de dinamismo en la expansión del universo tardío.

El DESI (Instrumento Espectroscópico para la Energía Oscura) ha irrumpido en el escenario con su última entrega de datos y ha traído más confusión que claridad al debate. Sus datos de BAO (Oscilaciones Acústicas de Bariones) sugieren que la energía oscura podría no ser esa constante cosmológica estática que imaginaba Einstein. Sugieren que podría ser algo dinámico que evoluciona con el tiempo cósmico. El modelo conocido como \( w_0 w_a \) (una parametrización que describe la ecuación de estado de la energía oscura mediante su valor actual \( w_0 w_a \) y su tasa de evolución temporal \( w_a \)) permite esta variabilidad y muestra una preferencia estadística interesante en las combinaciones de datos. Esto suena a revolución científica inminente pero la realidad es mucho más terca. El propio equipo de investigación de DESI ha dejado claro que permitir una energía oscura evolutiva no ayuda a resolver la tensión de Hubble en absoluto.

De hecho el valor de la constante de expansión que recuperan en ese escenario de energía dinámica es incluso más bajo que el valor propuesto por Planck. La idea de una energía oscura que cambia con el tiempo es fascinante porque ataca la base misma de la constante cosmológica clásica. Sin embargo en lugar de cerrar la brecha entre el 67 y el 73 parece estar abriendo nuevas grietas en otros sectores de la cosmología. Las tensiones en el crecimiento de estructuras y la consistencia interna entre diferentes catálogos de supernovas sugieren que el modelo estándar está bajo una presión insostenible. Pero cuidado con los titulares que anuncian la muerte definitiva del modelo \( \Lambda \mathrm{CDM} \) ya que sigue siendo un superviviente nato capaz de absorber casi cualquier anomalía con un poco de maquillaje matemático extra.

Modelos alternativos y propuestas de extensión física.

De la energía oscura temprana a las modificaciones del marco gravitacional.

La comunidad científica internacional se divide ahora mismo en tres familias que intentan arreglar este desastre antes de que la financiación se agote. La primera familia apuesta por modificar la física del universo temprano. Proponen la EDE (Energía Oscura Temprana) que sería una componente que actuó justo antes de que el universo se volviera transparente para reducir el horizonte sonoro y empujar el valor inferido hacia arriba. El problema es que los últimos datos de telescopios terrestres como el ACT (Telescopio de Cosmología de Atacama) no encuentran pruebas sólidas de este fenómeno. Es una solución elegante sobre el papel pero los datos reales la están castigando con una severidad implacable en los últimos meses.

La segunda familia prefiere mirar hacia la física tardía o hacia modificaciones globales de la gravedad a grandes escalas. Aquí es donde entran los escenarios de vacío local o las interacciones exóticas en el sector oscuro del universo. La idea de fondo es que quizás vivimos en una burbuja de baja densidad que nos engaña en nuestras mediciones locales. Pero estas propuestas suelen romper otras cosas que sí funcionan perfectamente como la formación de las grandes galaxias o el efecto de lente gravitacional. Finalmente queda la tercera vía que insiste en los errores sistemáticos residuales. Hay investigadores que todavía obtienen valores intermedios en torno a 70. Si el valor real fuera 70 la tensión se reduciría a un margen de desviación compatible con la incertidumbre del modelo estándar pero la red H0DN insiste en que el 73 es el único número real posible.

Perspectivas sobre el futuro del marco cosmológico.

La transición hacia una nueva fase en la comprensión del universo.

En abril de 2026 el estado real de la cosmología es el de una tensión insoportable que no admite más parches temporales. El informe de consenso H0DN ha cerrado definitivamente la puerta a las explicaciones fáciles basadas en errores locales simples de calibración. La sofisticación de los protocolos actuales invalida la posibilidad de que la discrepancia sea producto de sesgos instrumentales básicos o de una imprecisión fundamental en la determinación de la escala de distancias galácticas. La rama local es sólida como una roca y la rama del universo temprano también lo es en su propio contexto. El resultado es una inconsistencia que nos obliga a considerar seriamente que nos falta una pieza fundamental en nuestro rompecabezas de la realidad física. No es una fractura definitiva todavía porque el modelo estándar sigue explicando casi todo lo demás con una eficacia envidiable.

REPORTE DE PRECISIÓN LOCAL H0DN. La red de medición local ha logrado reducir su incertidumbre total al 0,9 por ciento mediante el uso de múltiples indicadores que se calibran entre sí de forma cruzada.

ESTADO DE LA ENERGÍA OSCURA DINÁMICA. Los datos del instrumento DESI sugieren una evolución temporal en la densidad de energía oscura aunque esto no soluciona el problema de la constante de Hubble.

LIMITACIONES DE LA FÍSICA TEMPRANA. Las propuestas de energía oscura temprana están perdiendo el favor de la comunidad científica debido a la falta de señales claras en los mapas de alta resolución del fondo cósmico.

Referencias y lecturas de rigor científico.

Consorcio H0DN sobre la robustez de la expansión local. arXiv.2510.23823

Análisis de DESI DR2 y la hipótesis de energía oscura dinámica. DESI Collaboration 2025

Restricciones de la misión Planck sobre modelos de energía oscura temprana. arXiv.2311.00524

🧠 DEBATE TECNOTIMES | COSMOLOGÍA 2026

¿Está roto el modelo estándar o estamos midiendo mal el universo?

- 🧩 ¿Tiene sentido seguir ajustando \( \Lambda \mathrm{CDM} \) o estamos ante un cambio de paradigma inevitable?

- 🔬 ¿La discrepancia es física real o un artefacto oculto en las metodologías de medición?

- ⚙️ ¿La energía oscura dinámica \( (w_0, w_a) \) es una solución o solo otro parche elegante?

- 🚨 ¿Estamos sobreinterpretando modelos matemáticos que encajan bien… pero no representan la realidad?

JL Meana — TecnoTimes

Divulgación científica con honestidad. Sin obediencia ideológica. Sin cuentos.

“Neutralidad no es objetividad y propaganda no es periodismo.”