Un error humano para la historia de la programación.

El mapa de origen que desnudó al agente más avanzado del mercado.

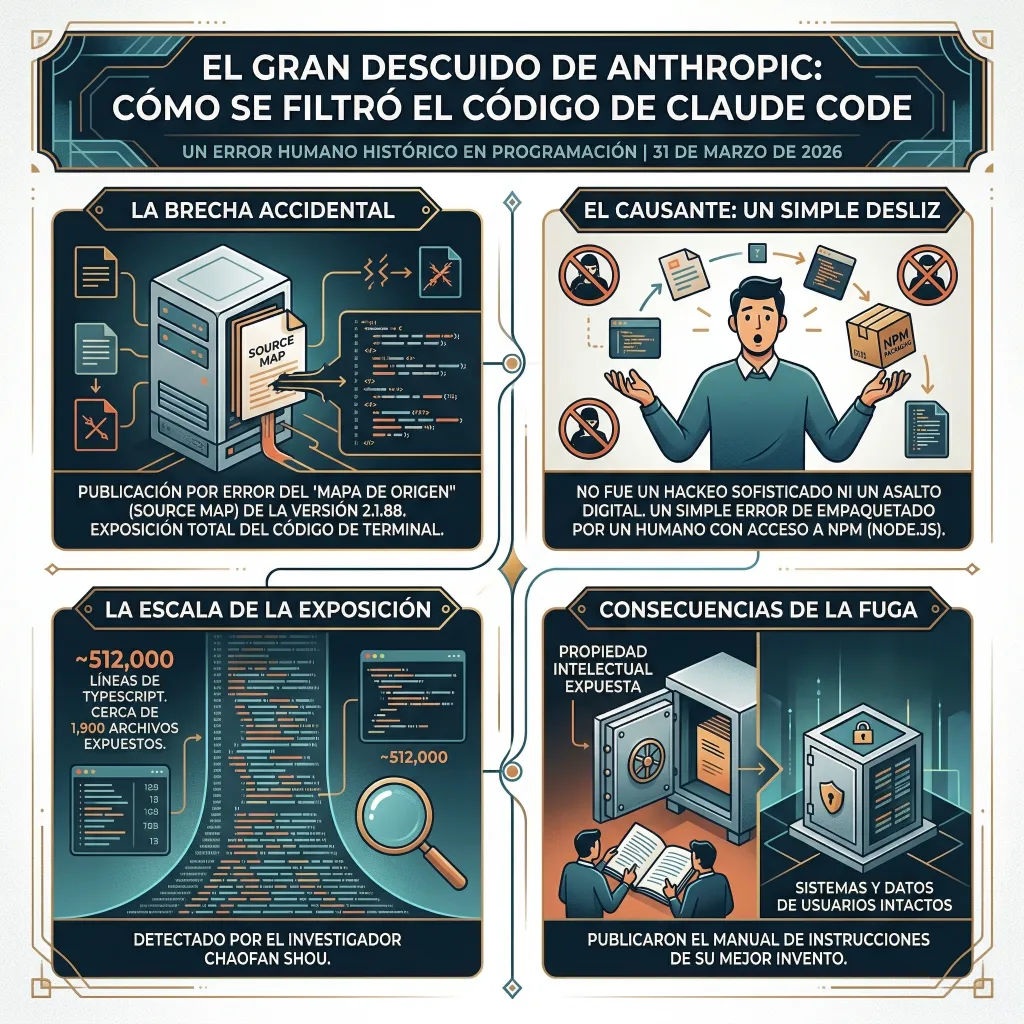

El pasado 31 de marzo de 2026 quedará marcado en el calendario tecnológico como el día en que la precaución decidió tomarse unas vacaciones en las oficinas de Anthropic. La empresa que presume de seguridad y ética publicó por accidente un mapa de origen (source map) de la versión 2.1.88 de Claude Code. Este pequeño archivo técnico que suele ayudar a los programadores a depurar errores terminó por exponer el código fuente completo de su herramienta de terminal. No fue una intrusión sofisticada ni un grupo de asalto digital ruso. Fue un simple error de empaquetado cometido por un humano con acceso a la gestión de paquetes de Node.js (npm).

El descuido no es una anécdota menor para llenar minutos en redes sociales. Hablamos de la exposición de unas 512.000 líneas de TypeScript (lenguaje de programación basado en JavaScript) repartidas en casi 1.900 archivos. El investigador Chaofan Shou detectó la brecha y el resto es historia de réplicas en espejos digitales. Anthropic confirmó que sus sistemas están intactos y que los datos de los clientes no corren peligro, pero el daño a su propiedad intelectual es un incendio difícil de apagar. La empresa que quería dominar el mercado de los agentes autónomos acaba de publicar el manual de instrucciones de su mejor invento.

La anatomía de una filtración masiva de código.

Medio millón de líneas que cuentan la verdad sobre los agentes.

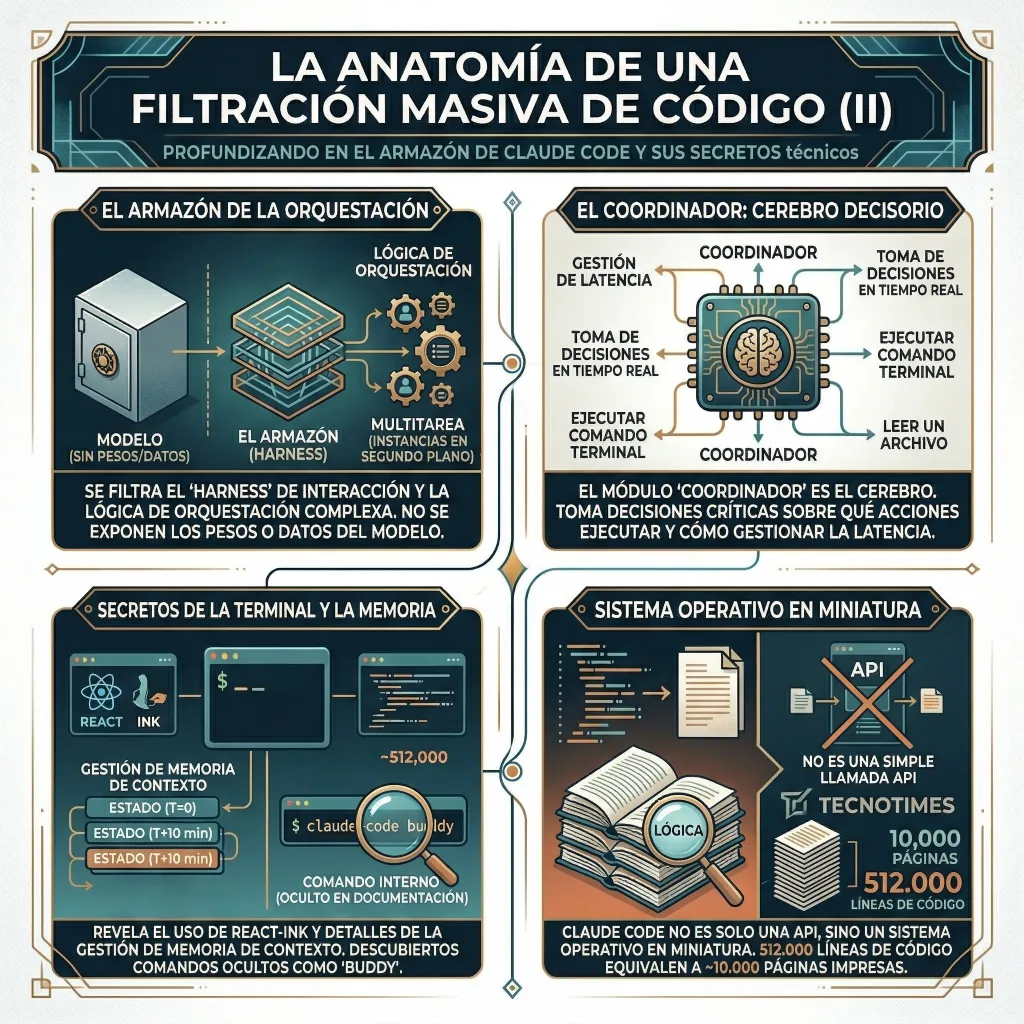

El volumen del código filtrado permite una autopsia técnica sin precedentes sobre cómo funciona realmente un agente de inteligencia artificial (IA). Lo que se ha expuesto es el armazón (harness), que permite a Claude interactuar con el mundo real. No están los pesos del modelo ni los datos de entrenamiento pero sí toda la lógica de orquestación. El módulo denominado Coordinador (Coordinator) es el cerebro que decide cuándo abrir un archivo, o cuándo ejecutar un comando en la terminal del usuario. Es una arquitectura compleja que revela cómo Anthropic intenta dominar la multitarea mediante la ejecución de múltiples instancias del modelo en segundo plano.

Entre los archivos aparecen menciones a la interfaz construida con React-Ink que da vida a esa terminal que los desarrolladores tanto aman. También se han descubierto los comandos internos como el comando buddy, que activa funciones que todavía no estaban en la documentación oficial. La filtración es tan profunda que permite ver incluso cómo el sistema gestiona la memoria de contexto para que Claude no olvide lo que hiciste hace diez minutos. Es un festín para los competidores que ahora pueden ver exactamente cómo se resuelven los problemas de latencia y de toma de decisiones en tiempo real.

DATO TECNOTIMES. Las 512.000 líneas de código filtradas equivalen aproximadamente a 10.000 páginas de texto impreso si se decidiera encuadernar el error de Anthropic. Es un volumen masivo de lógica que deja claro que Claude Code no es solo una llamada a una interfaz de programación de aplicaciones (API) sino un sistema operativo en miniatura.

Zoológico de modelos y mascotas virtuales.

Capybara y Fennec son los nombres del futuro filtrado.

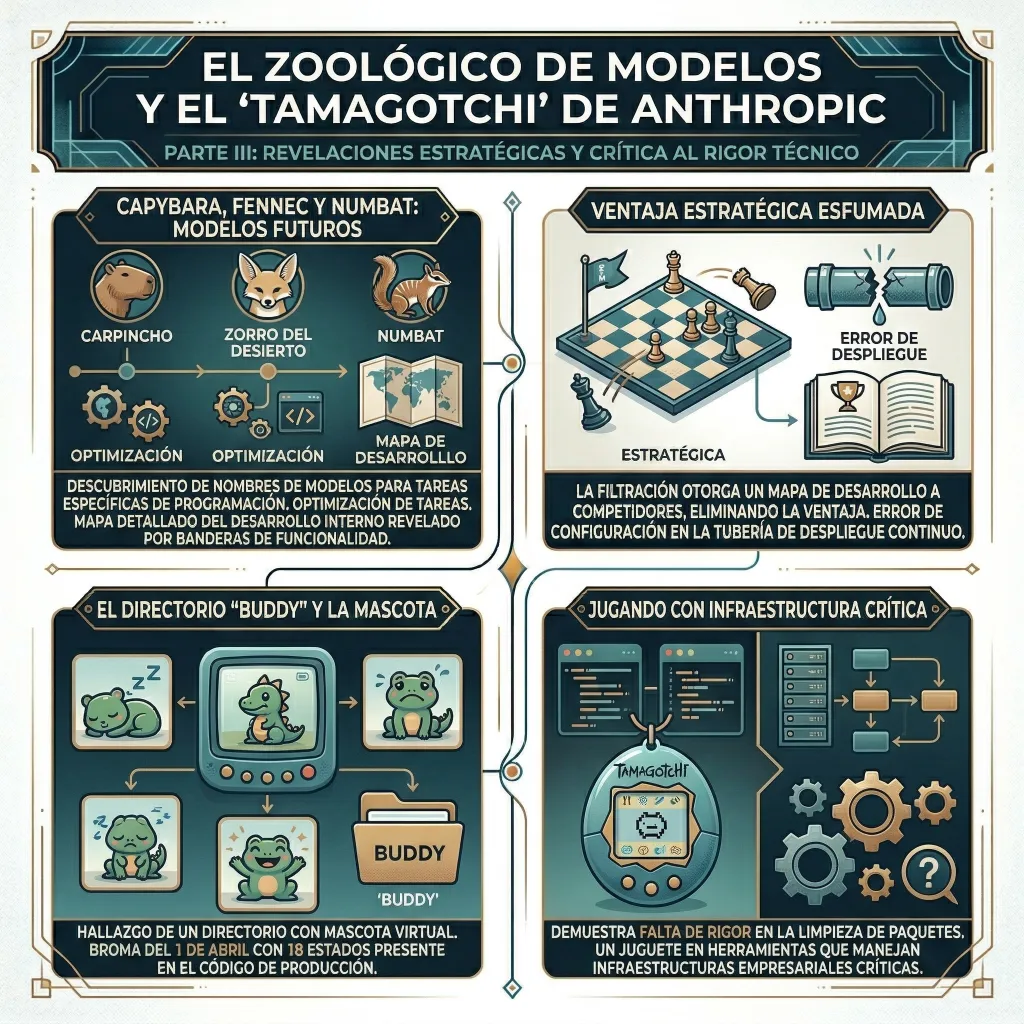

La curiosidad más llamativa de esta filtración no es solo técnica sino estratégica. El código fuente menciona explícitamente nombres de modelos futuros como Capybara (Capibara) o Fennec (Zorro del desierto) y Numbat (hormiguero marsupial). Estos términos sugieren que Anthropic está trabajando en una nueva generación de modelos optimizados para tareas específicas de programación. El descubrimiento de estas banderas de funcionalidad (feature flags) otorga a la industria un mapa detallado del desarrollo interno de la compañía para los próximos meses. Es una ventaja competitiva que se ha esfumado por un error de configuración en la tubería de despliegue continuo.

Pero no todo es geopolítica de datos y competencia feroz. Los analistas han encontrado un directorio llamado buddy que contiene una mascota virtual al puro estilo de los juegos de bolsillo de los años noventa. Esta rana o dragón digital tiene 18 estados diferentes y estaba programada para aparecer como una broma del primero de abril. Aunque parece algo inocente su presencia en el código de producción demuestra una falta de rigor en la limpieza de los paquetes antes de su lanzamiento. Anthropic ha incluido un tamagotchi en una herramienta que supuestamente maneja infraestructuras críticas de software empresarial.

La privacidad bajo la lupa de la telemetría agresiva.

Rastreo de obscenidades y acceso total al sistema huésped.

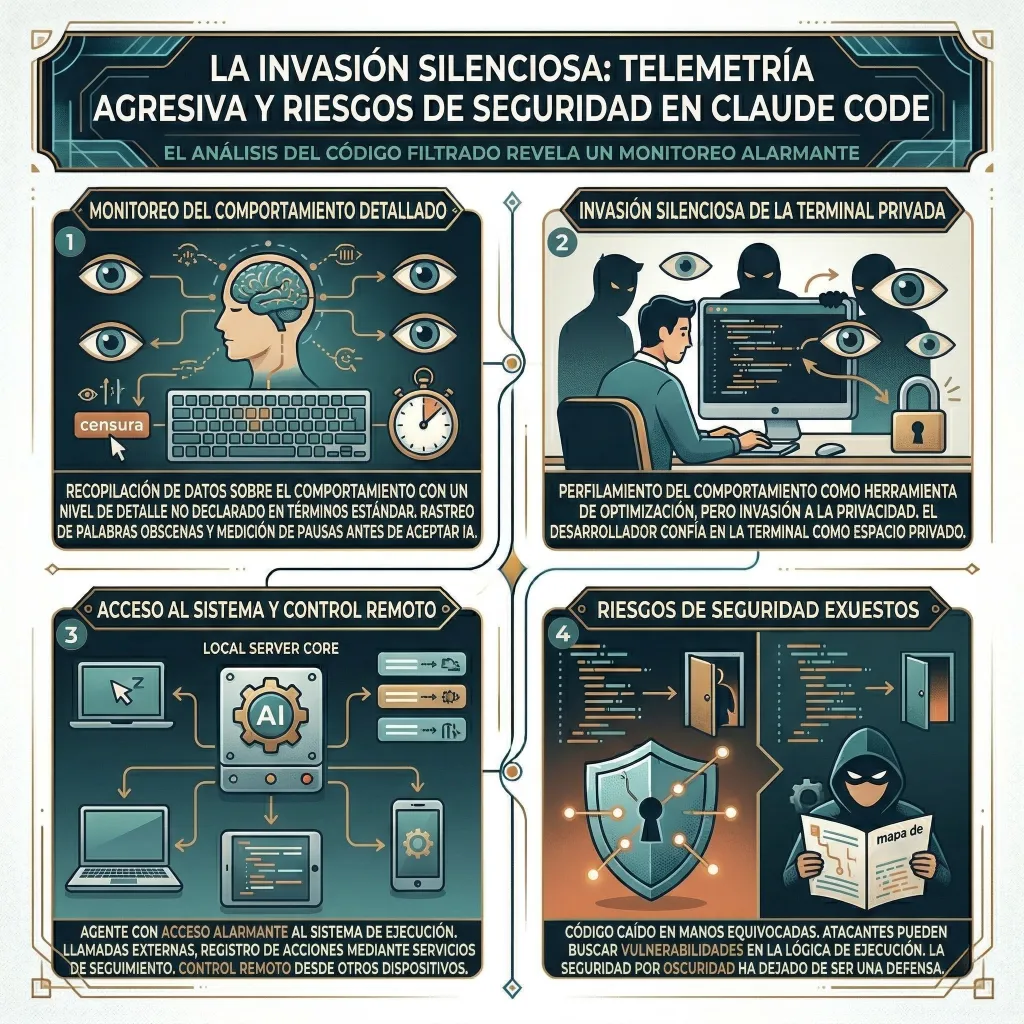

Lo que más debería preocupar a los usuarios no son las ranas digitales, sino los sistemas de telemetría y monitoreo descubiertos. El código revela que Claude Code recopila datos sobre el comportamiento del usuario con un nivel de detalle que no aparece en los términos de servicio estándar. Existe una función específica para rastrear el uso de palabras obscenas y medir las pausas que hace el programador antes de aceptar una sugerencia de la inteligencia artificial (IA). Este perfilamiento del comportamiento es una herramienta de optimización de productos, pero también es una invasión silenciosa a la privacidad del desarrollador que confía en que su terminal es un espacio privado.

El análisis técnico indica que el agente tiene un acceso alarmante al sistema donde se ejecuta. Puede realizar llamadas externas y registrar cada acción mediante servicios de seguimiento como Statsig o GrowthBook. Se ha detectado incluso un módulo de acceso remoto que permite controlar el agente desde otros dispositivos. Si este código cae en manos equivocadas los atacantes podrían encontrar formas de inducir comportamientos maliciosos, aprovechando estas puertas de entrada documentadas en el código filtrado. La seguridad por oscuridad ha dejado de ser una defensa para Anthropic y ahora cualquier experto puede buscar vulnerabilidades en su lógica de ejecución.

Conflictos de propiedad intelectual y el fantasma de la IA.

Derechos de autor sobre código que podría haber sido escrito por otra IA.

Tras la filtración Anthropic inició una ofensiva legal mediante avisos de retirada por infracción de derechos de autor (DMCA) en plataformas como GitHub. El objetivo es borrar cualquier rastro del código TypeScript , pero la tarea es similar a intentar secar el océano con una toalla. El problema legal es fascinante porque gran parte de ese código podría haber sido generado por el propio Claude durante su desarrollo. En jurisdicciones como la de Estados Unidos las obras creadas puramente por máquinas no gozan de protección automática de derechos de autor. Esto abre un debate sobre si un tercero puede usar ese código para crear una versión libre sin temor a represalias judiciales.

Ya han aparecido proyectos como Claw-Code que intentan reimplementar las funciones de la herramienta de Anthropic utilizando otros lenguajes como Python o Rust. Estos desarrolladores argumentan que están haciendo ingeniería inversa legítima sobre una filtración pública. La comunidad de código abierto está observando cómo una empresa que defiende la seguridad utiliza herramientas legales para ocultar un error propio. Mientras tanto el código sigue disponible en redes descentralizadas y foros de programación donde la censura de las grandes corporaciones no tiene alcance. La propiedad intelectual en la era de la inteligencia artificial (IA) acaba de recibir un golpe de realidad difícil de ignorar.

Mitigaciones necesarias y lecciones aprendidas.

Cómo evitar que tu código fuente se convierta en dominio público.

La lección principal para cualquier equipo de desarrollo es la revisión obsesiva de los archivos de exclusión en los gestores de paquetes. Ignorar el archivo npmignore es lo que permitió que el mapa de origen fuera visible para todo el mundo. Es fundamental automatizar auditorías que detecten la presencia de archivos fuente en los paquetes de producción antes de que lleguen al registro público. Anthropic ha prometido reforzar sus procesos internos pero la reputación de su ingeniería ha quedado tocada. Los usuarios de Claude Code deberían aislar sus entornos de trabajo en máquinas virtuales para evitar que la telemetría excesiva filtre secretos industriales hacia los servidores de la compañía.

RECOMENDACIÓN DE SEGURIDAD. Se sugiere desactivar la memoria persistente mediante variables de entorno como la detectada en el código llamada CLAUDE_CODE_DISABLE_AUTO_MEMORY. Limitar el acceso del agente a internet mediante cortafuegos también es una práctica recomendada para quienes trabajan con datos sensibles.

AUDITORÍA DE PAQUETES. Las empresas deben implementar herramientas de análisis estático que verifiquen que ningún mapa de origen o archivo de configuración interna se cuele en las entregas finales. El error humano es inevitable pero la falta de sistemas de verificación automáticos es una elección técnica arriesgada.

DIVERSIFICACIÓN DE FUENTES. No es prudente depender de un solo proveedor de agentes autónomos. Mantener versiones locales o alternativas de código abierto permite mitigar el riesgo si una herramienta propietaria sufre una filtración masiva o cambia sus políticas de privacidad de la noche a la mañana.

Referencias relacionadas.

Análisis de la filtración en Axios sobre el impacto en Anthropic. Enlace al artículo

Reporte técnico de The Register sobre los riesgos de privacidad detectados en el código. Enlace al artículo

Detalles del error humano en la plataforma npm según InfoWorld. Enlace al artículo

🧠 DEBATE TECNOTIMES | CLAUDE CODE LEAK 2026

¿Es ético usar el código filtrado de una IA para crear alternativas libres?

- 🧩 ¿Debería el código generado por IA ser siempre de código abierto por defecto?

- 🔐 ¿Es la telemetría oculta una traición a la confianza de los desarrolladores?

- ⚙️ ¿Puede una empresa de seguridad permitirse errores de empaquetado tan básicos?

- 🚨 ¿Hasta qué punto debemos permitir que un agente IA tenga acceso total a nuestra terminal?

JL Meana — TecnoTimes

Divulgación científica con honestidad. Sin obediencia ideológica. Sin cuentos.

“Neutralidad no es objetividad y propaganda no es periodismo.”

Super interesante ! ahora le puedo decir a mi claude code que me genere un claude code !

😂Esto no fue una filtración… fue un tutorial premium involuntario…