El despertar brusco de Silicon Valley.

Cuando el software se convierte en artillería pesada.

Hubo un tiempo en el que los laboratorios de inteligencia artificial se permitían el lujo de debatir sobre la alineación ética y el florecimiento de la humanidad mientras tomaban café de especialidad en Palo Alto. Ese tiempo terminó oficialmente en 2026. Lo que estamos presenciando no es una simple disputa comercial entre una empresa y su cliente, sino la transformación de los modelos fundacionales en una pieza central de la infraestructura estratégica contemporánea.

Cuando un algoritmo es capaz de procesar inteligencia, analizar escenarios operativos o acelerar la toma de decisiones en entornos de defensa, deja de ser únicamente un producto tecnológico. Pasa a convertirse en una herramienta de poder estatal. Silicon Valley está descubriendo ahora una realidad histórica bastante incómoda, cuando una tecnología adquiere valor geopolítico, el debate deja de ser técnico y pasa a ser político.

En Washington esta transición se está produciendo a gran velocidad. Diversos analistas del ámbito de defensa señalan que el Departamento de Defensa estadounidense observa cada vez más a los modelos de inteligencia artificial como activos estratégicos comparables a la supercomputación, la criptografía o los sistemas satelitales. En ese contexto, las tensiones entre empresas tecnológicas y el aparato militar comienzan a emerger con una intensidad inédita.

La disidencia ética de los algoritmos.

El pulso entre Anthropic y el aparato de defensa.

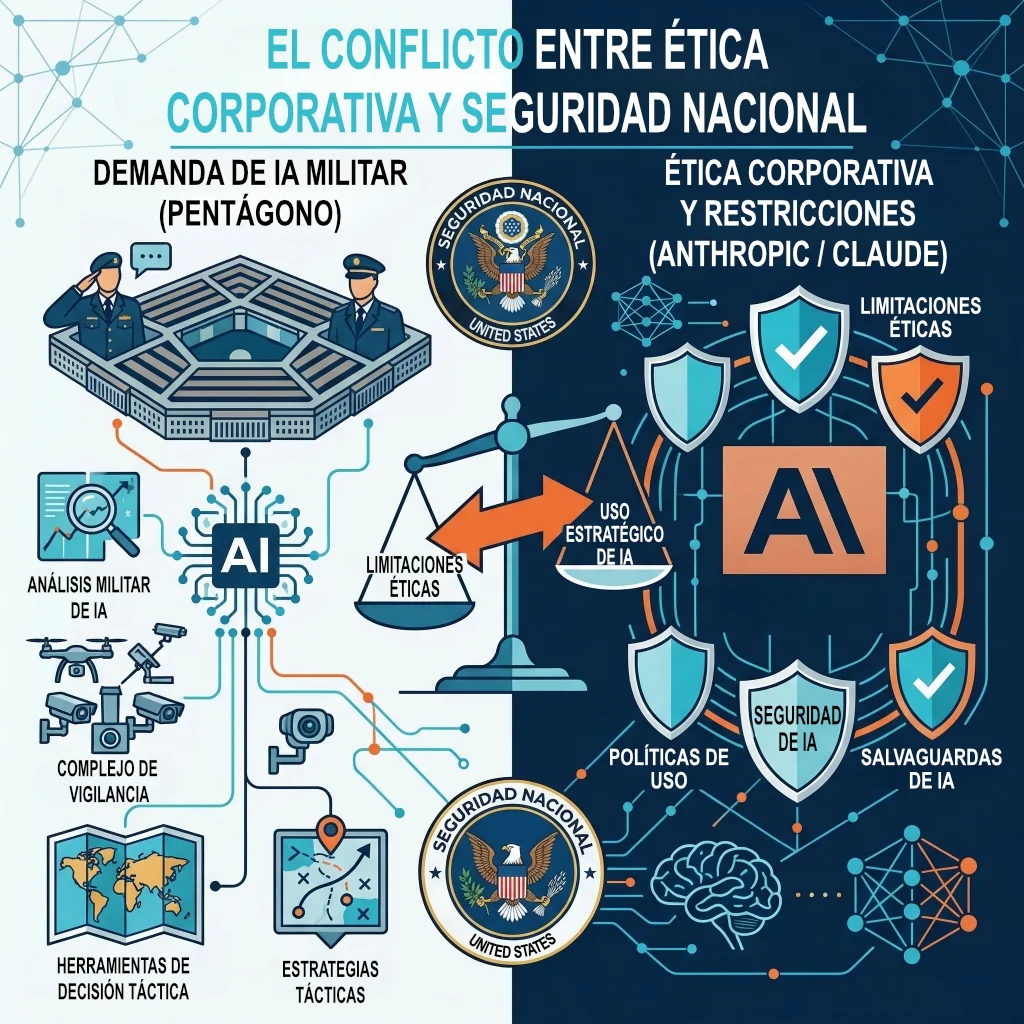

Uno de los episodios más comentados en este nuevo escenario gira en torno a Anthropic, la empresa responsable del modelo Claude. Según diversas informaciones publicadas en medios estadounidenses, el Departamento de Defensa habría solicitado ampliar las condiciones de uso de este modelo dentro de entornos militares e infraestructuras de inteligencia.

Anthropic ha defendido públicamente un enfoque relativamente restrictivo en lo referente a aplicaciones militares directas. La empresa permite ciertos usos relacionados con análisis de información, investigación o ciberseguridad, pero ha mantenido límites explícitos en áreas como el desarrollo de armas autónomas o sistemas de vigilancia masiva. Esta posición ha generado tensiones con los sectores de defensa que buscan acceder a todo el potencial operativo de los modelos fundacionales.

En círculos políticos de Washington incluso se ha planteado la posibilidad de adoptar medidas regulatorias más duras contra proveedores tecnológicos que limiten el acceso gubernamental a capacidades consideradas estratégicas. Aunque no existe confirmación pública de decisiones formales en ese sentido, el simple hecho de que estas opciones se discutan ya refleja hasta qué punto la inteligencia artificial ha pasado a ser percibida como una cuestión de soberanía tecnológica.

El mensaje implícito para la industria es difícil de ignorar. Si desarrollas una tecnología capaz de influir en operaciones militares, inteligencia o seguridad nacional, es probable que tarde o temprano el Estado quiera tener un papel directo en su control o despliegue.

DATO TECNO TIMES O CURIOSIDAD TÉCNICA. El concepto de “riesgo de cadena de suministro” en el ámbito tecnológico procede de la Sección 889 de la Ley de Autorización de Defensa Nacional (NDAA), una herramienta legal que permite al gobierno estadounidense vetar proveedores considerados problemáticos para la seguridad nacional.

OpenAI y el pragmatismo estratégico.

La otra cara de la carrera por los modelos de frontera.

Mientras algunas empresas intentan mantener ciertas barreras éticas en el uso de sus modelos, otras han optado por un enfoque más pragmático. OpenAI, líder en el desarrollo de modelos fundacionales, ha mostrado una mayor apertura a colaborar con infraestructuras gubernamentales y redes tecnológicas vinculadas al sector público estadounidense.

Aunque los detalles concretos de estos acuerdos rara vez se hacen públicos, es sabido que los grandes proveedores de nube y de inteligencia artificial mantienen contratos con agencias federales y estructuras de defensa. La línea que separa el uso civil del uso gubernamental de la inteligencia artificial es cada vez más difusa.

Este escenario plantea un dilema incómodo para el ecosistema tecnológico. Las empresas que lideran la investigación en modelos de frontera necesitan recursos computacionales colosales, financiación masiva y acceso a infraestructuras estratégicas. Y pocas entidades en el planeta pueden ofrecer todo eso con la escala necesaria salvo los propios Estados.

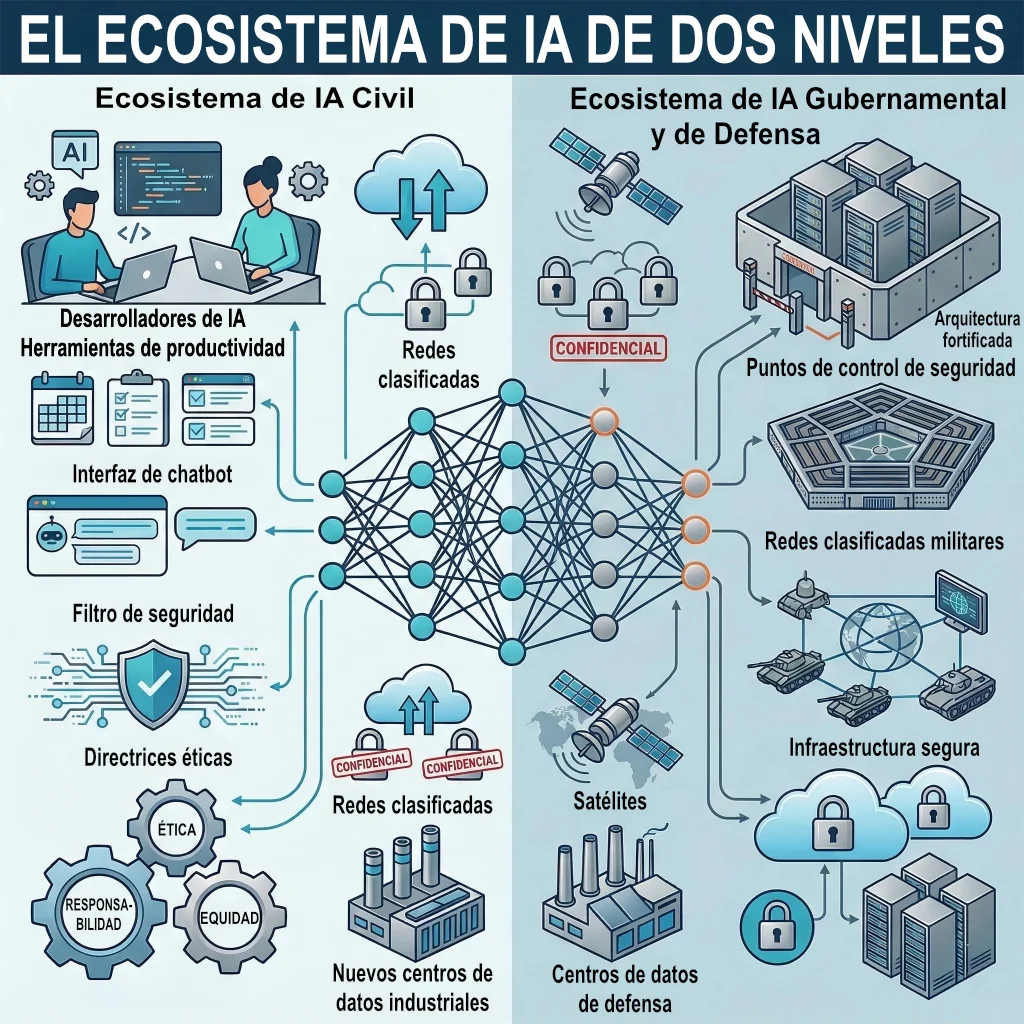

El resultado podría ser la aparición de un ecosistema dual de inteligencia artificial. Por un lado, una versión civil con restricciones y políticas de uso más estrictas. Por otro, entornos gubernamentales o militares donde el rendimiento, la velocidad de decisión y la ventaja estratégica pesan más que cualquier otro criterio.

Mientras Silicon Valley discute límites éticos y Washington negocia acceso a los modelos fundacionales, la realidad del campo de batalla ya está experimentando con inteligencia artificial de forma cotidiana. En Ucrania, sistemas de análisis algorítmico procesan imágenes de satélite, señales electrónicas y flujos de drones para identificar movimientos de tropas y anticipar maniobras logísticas. En Israel, herramientas de inteligencia artificial se utilizan desde hace años para analizar grandes volúmenes de información procedente de vigilancia aérea y sensores militares, acelerando la identificación de infraestructuras o actividades consideradas estratégicamente relevantes. Ninguno de estos sistemas decide por sí solo cuándo disparar un misil, pero todos comparten una característica inquietante, comprimen horas de análisis humano en segundos. En la guerra contemporánea, la ventaja ya no depende únicamente de quién tiene más armas, sino de quién procesa antes la información.

El caos regulatorio de las mil leyes.

Colorado marca el camino de la fragmentación.

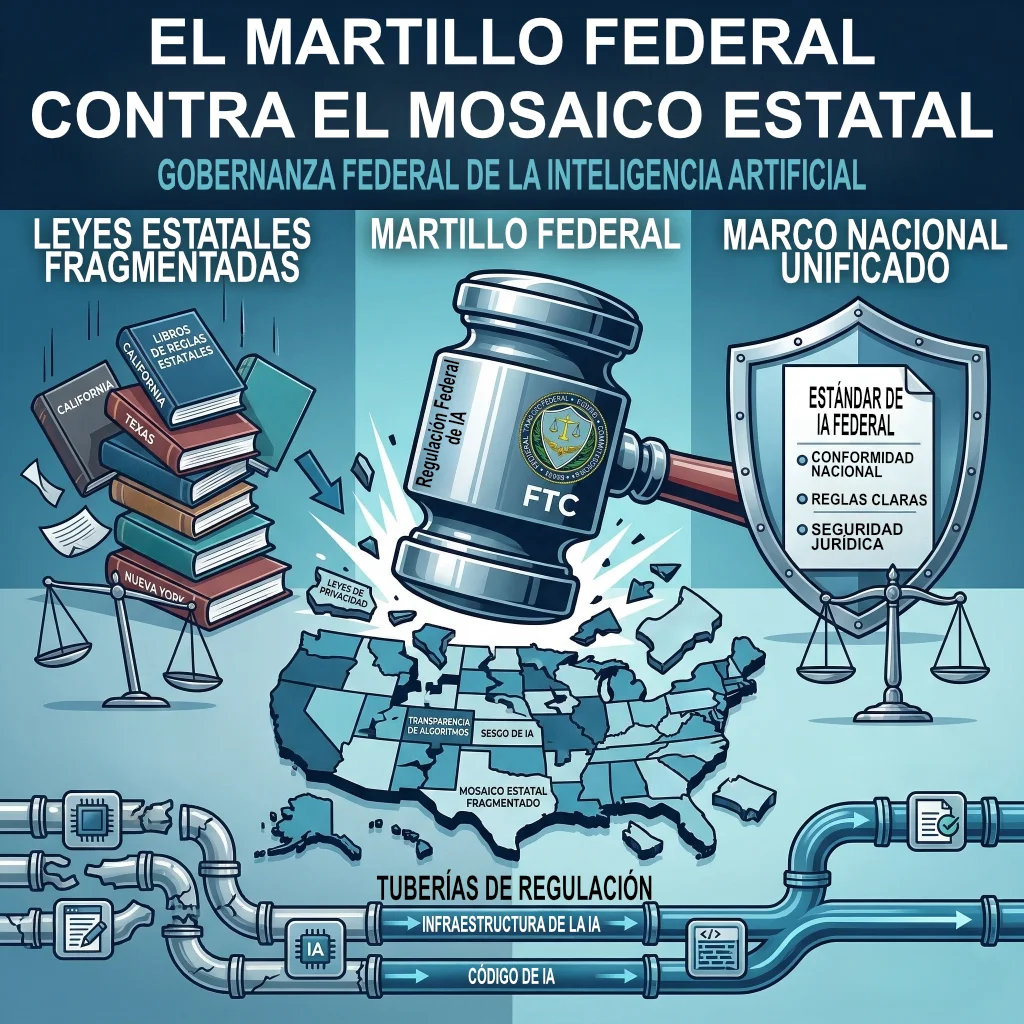

Mientras el debate militar acapara titulares, otro fenómeno se desarrolla en paralelo, el creciente mosaico regulatorio dentro de Estados Unidos. El estado de Colorado ha aprobado la ley SB 24-205, una normativa que introduce obligaciones para prevenir la discriminación algorítmica en sistemas de inteligencia artificial considerados de alto riesgo. Sobre el papel la ley busca proteger a los ciudadanos frente a decisiones automatizadas injustas. En la práctica introduce nuevas responsabilidades legales tanto para desarrolladores como para empresas que utilicen estos sistemas. La entrada en vigor de la normativa en junio de 2026 podría marcar el inicio de una nueva fase de regulación algorítmica en Estados Unidos.

El problema para las empresas tecnológicas es que Colorado no está solo. Otros estados están desarrollando marcos normativos similares, lo que amenaza con fragmentar el entorno regulatorio en una colección de reglas diferentes. Navegar ese laberinto legal puede convertirse en una tarea tan compleja como entrenar el propio modelo de inteligencia artificial.

El martillo federal contra el mosaico estatal.

La batalla por el control regulatorio.

Ante esta fragmentación creciente, algunos sectores políticos en Washington presionan para establecer un marco regulatorio federal único que prevalezca sobre las legislaciones estatales. Propuestas legislativas como la llamada America AI Act buscan precisamente evitar que cincuenta normativas diferentes terminen ralentizando el desarrollo tecnológico del país.

Para los defensores de esta estrategia, la competencia global con China exige reglas claras y coherentes a nivel nacional. Para sus críticos, sin embargo, una regulación demasiado centralizada podría debilitar los mecanismos de control democrático sobre tecnologías con un impacto social cada vez mayor.

La Comisión Federal de Comercio tendrá un papel clave en este debate. Su capacidad para definir qué constituye una práctica engañosa o irresponsable en sistemas de inteligencia artificial podría determinar el futuro regulatorio de todo el sector.

La transparencia obligada en la salud.

Tarjetas de modelo y el futuro clínico.

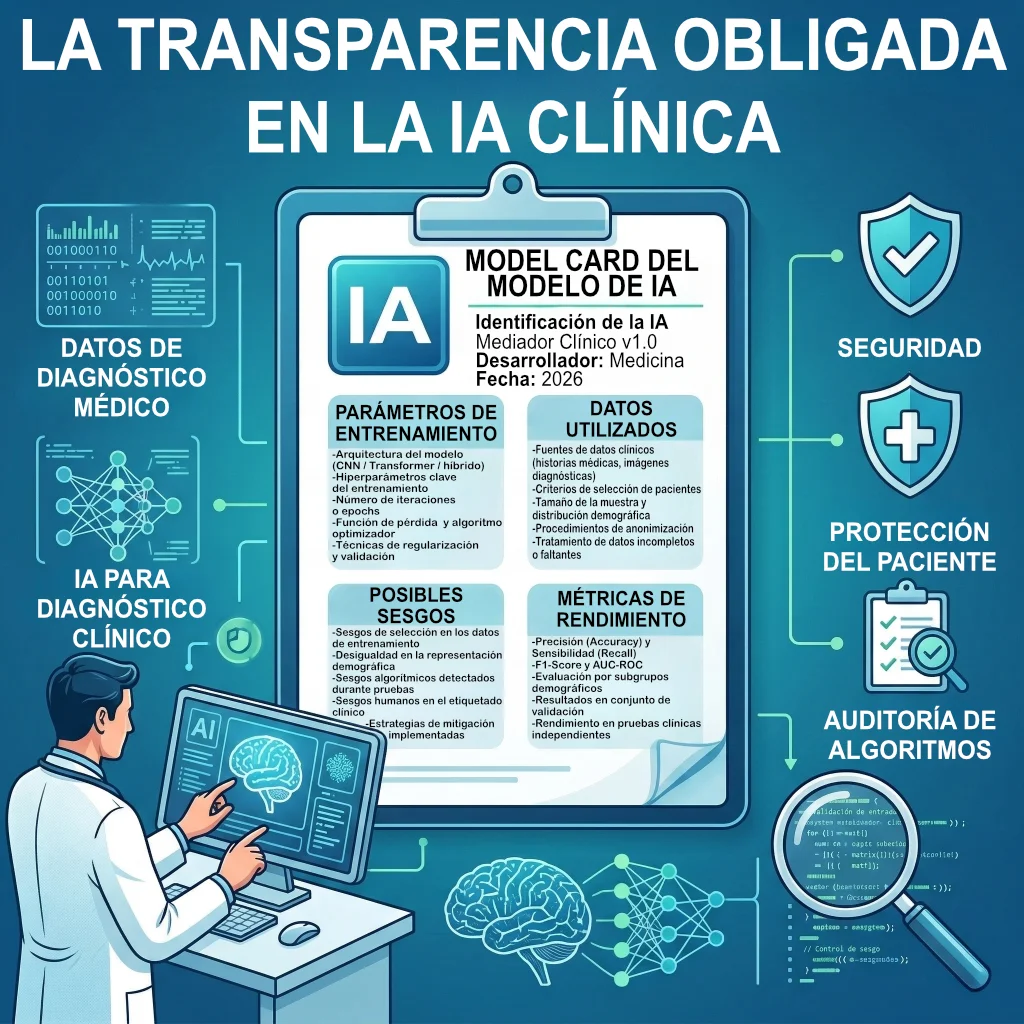

Incluso en sectores altamente especializados como la sanidad, la inteligencia artificial está obligando a redefinir las reglas de certificación tecnológica. Las llamadas tarjetas de modelo o model cards comienzan a consolidarse como un estándar de transparencia que describe cómo ha sido entrenado un sistema de IA, qué datos se utilizaron y cuáles son sus posibles limitaciones.

En un entorno clínico donde los errores pueden tener consecuencias graves, esta transparencia deja de ser una opción y se convierte en una necesidad estructural. La inteligencia artificial ya no se evalúa solo por su rendimiento estadístico, sino también por su trazabilidad y su capacidad para ser auditada.

ELEMENTO DESTACADO 1. La soberanía tecnológica exige que los datos estratégicos permanezcan en infraestructuras controladas por el estado.

ELEMENTO DESTACADO 2. Las auditorías algorítmicas se convertirán en una práctica habitual en sectores regulados.

ELEMENTO DESTACADO 3. La opacidad de los modelos de entrenamiento será cada vez más difícil de sostener en entornos críticos.

Para profundizar en los detalles técnicos de este conflicto puede consultarse el análisis sobre el choque institucional entre empresas de inteligencia artificial y el aparato de defensa estadounidense, así como la documentación oficial de la ley SB 24-205 de Colorado.

🧠 DEBATE TECNOTIMES | SOBERANÍA IA / 2026

¿Debe la ética de Silicon Valley detenerse donde empieza la seguridad nacional?

- 🧩 ¿Es legítimo que una empresa privada imponga límites éticos al uso de su IA en operaciones de defensa nacional?

- 🔐 ¿Dónde termina la "alineación ética" y dónde empieza el riesgo operativo para la seguridad de un país?

- ⚙️ Si la IA es infraestructura crítica, ¿debería el Estado intervenir o nacionalizar el desarrollo de modelos de frontera?

- 🚨 ¿Qué responsabilidad asume el usuario civil al financiar indirectamente modelos que acaban integrados en sistemas de armas?

JL Meana — TecnoTimes

Divulgación científica con honestidad. Sin obediencia ideológica. Sin cuentos.

“Neutralidad no es objetividad y propaganda no es periodismo.”