La evolución de los modelos de lenguaje hacia la autonomía estructural.

Del ajuste manual a la corrección autónoma.

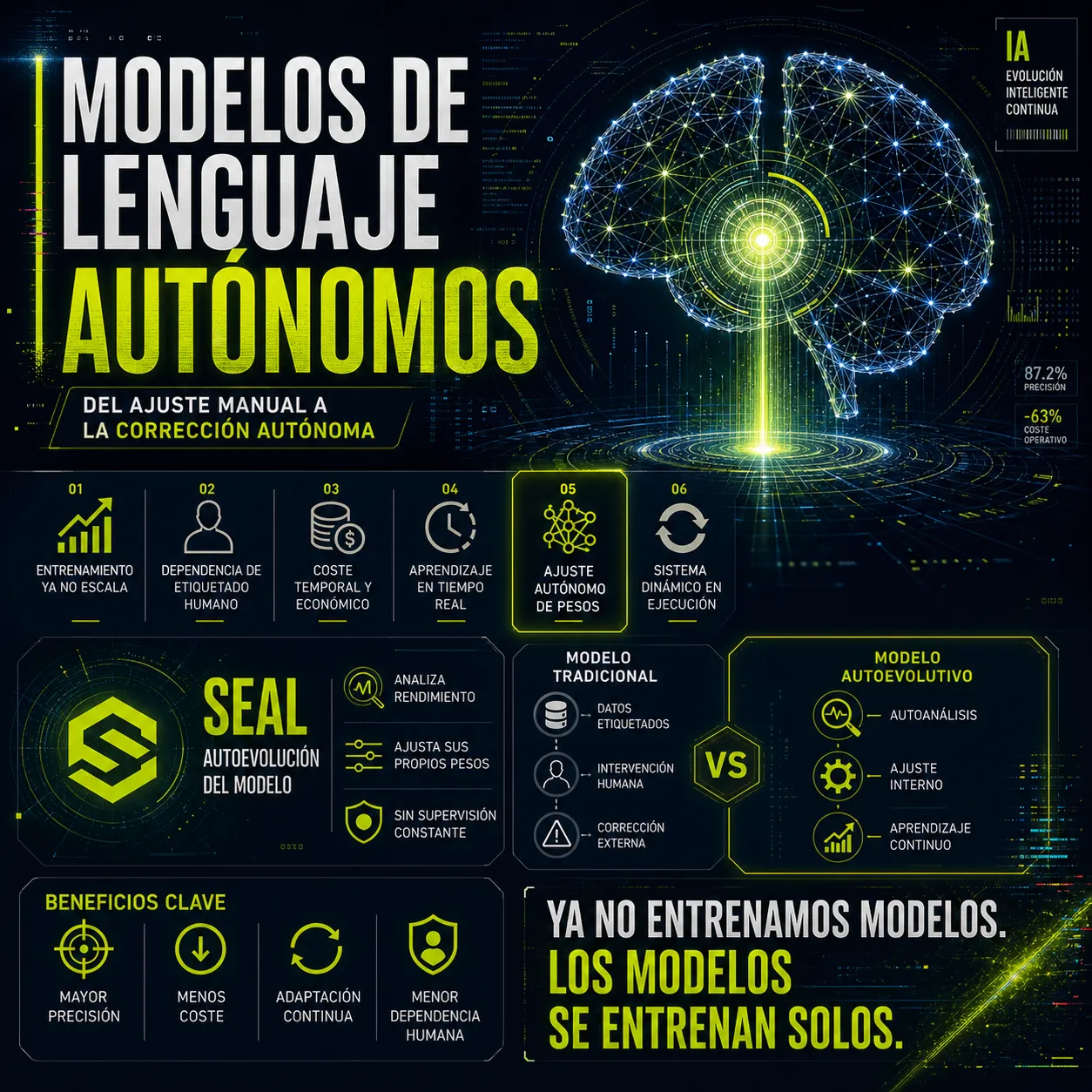

El desarrollo de la inteligencia artificial ha alcanzado un punto de inflexión donde los métodos tradicionales de entrenamiento resultan insuficientes ante la demanda de procesamiento actual. Hasta hace poco la optimización de un modelo dependía exclusivamente del proceso de ajuste fino o fine-tuning. Esta técnica requiere la intervención humana constante para etiquetar datos y corregir errores de salida, lo que implica un consumo masivo de recursos temporales y económicos. Sin embargo la aparición de arquitecturas capaces de modificar su propio conocimiento en tiempo real está desplazando este paradigma hacia un modelo de autogestión neuronal.

El marco SEAL (Self-Evolutionary Adaptive Learning o Aprendizaje Adaptativo Autoevolutivo) representa el avance más significativo en esta dirección. A diferencia de los sistemas estáticos, SEAL permite que el algoritmo analice su rendimiento y ajuste sus propios pesos neuronales sin necesidad de una supervisión externa constante. Esta capacidad de autoevaluación transforma al modelo de lenguaje en un sistema dinámico que aprende durante su fase de ejecución, lo que reduce drásticamente la dependencia de los conjuntos de datos pre-etiquetados por humanos.

El motor del cambio. Aprendizaje por refuerzo y bucles internos.

La arquitectura técnica detrás de la autoevolución neuronal.

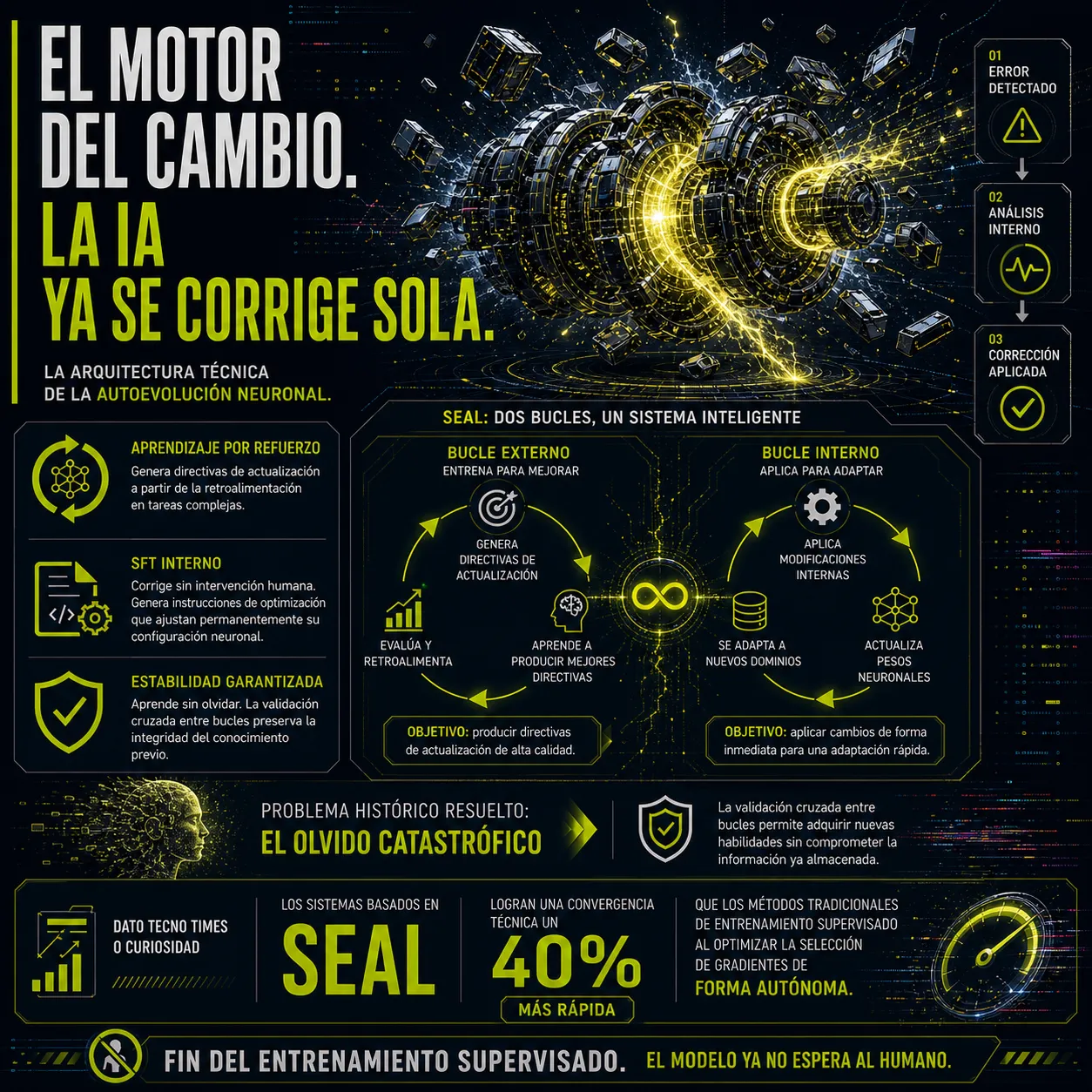

La eficiencia de SEAL se fundamenta en la implementación de un bucle de aprendizaje por refuerzo o Reinforcement Learning. Este mecanismo permite al modelo generar sus propias directivas de actualización a partir de la retroalimentación obtenida en tareas complejas. Cuando el sistema detecta una imprecisión en su razonamiento lógico no espera una actualización externa. En su lugar activa una fase de SFT (Supervised Fine-Tuning o Ajuste Fino Supervisado) interna donde genera instrucciones de optimización que modifican permanentemente su configuración neuronal para evitar la repetición del error.

Para garantizar la estabilidad del sistema el marco SEAL opera mediante dos procesos cíclicos. El bucle externo se encarga de entrenar al modelo para que sea capaz de producir directivas de actualización de alta calidad, el bucle interno aplica estas modificaciones de forma inmediata permitiendo una adaptación rápida a nuevos dominios de conocimiento. Esta estructura resuelve uno de los problemas históricos de las redes neuronales, el olvido catastrófico. Gracias a la validación cruzada entre bucles la IA puede adquirir nuevas habilidades sin comprometer la integridad de la información almacenada previamente.

DATO TECNO TIMES O CURIOSIDAD TÉCNICA. Los sistemas basados en SEAL logran una convergencia técnica un 40% más rápida que los métodos tradicionales de entrenamiento supervisado al optimizar la selección de gradientes de forma autónoma.

Del entrenamiento estático a la inferencia adaptativa.

Impacto en la gestión de infraestructuras tecnológicas.

La transición hacia modelos autoadaptativos conlleva un cambio profundo en la estructura de costes de los departamentos de TI (tecnologías de la información). En el modelo convencional el gasto principal se concentraba en la fase de entrenamiento inicial. Con la llegada de SEAL la inversión se desplaza hacia la inferencia adaptativa, esto significa que el sistema consume recursos computacionales de manera continua para refinarse mientras opera. El coste operativo deja de ser un valor fijo para convertirse en una variable ligada a la evolución y el aprendizaje constante de la herramienta en entornos de producción.

Este cambio obliga a las empresas a replantear su estrategia de hardware. La capacidad de un modelo para generar sus propios datos de entrenamiento mediante simulaciones internas reduce la necesidad de almacenamiento masivo de datos externos. El valor estratégico ya no reside en poseer la base de datos más grande, sino en disponer de la capacidad de cómputo necesaria para sostener los ciclos de automejora. Las corporaciones deben prepararse para gestionar sistemas que en lugar de degradarse con el uso aumentan su precisión y complejidad de manera autónoma con el paso del tiempo.

La ingeniería de software en la era de los agentes autónomos.

Hacia una supervisión arquitectónica de alto nivel.

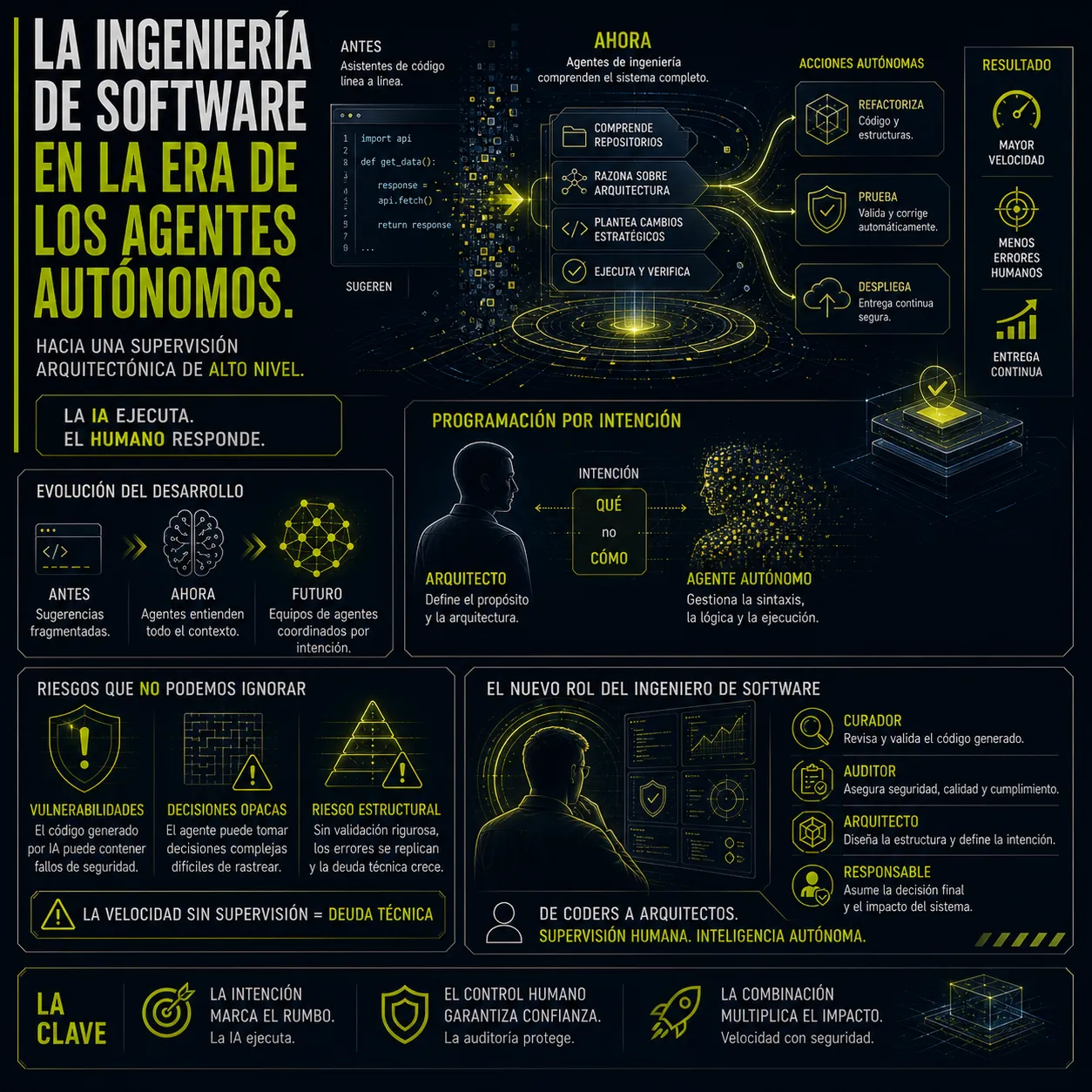

La evolución de los modelos de lenguaje también ha transformado la forma en la que se desarrolla el software. Hemos pasado de asistentes de código que sugerían líneas individuales, a agentes de ingeniería capaces de comprender repositorios completos. Estos agentes autónomos pueden realizar refactorizaciones complejas y gestionar el despliegue de aplicaciones sin intervención humana directa. Este fenómeno se conoce en la industria como Vibe-Coding, o programación orientada a la intención, donde el desarrollador humano actúa como un arquitecto que define el propósito del sistema mientras la IA gestiona la sintaxis y la lógica subyacente.

A pesar de la eficiencia que aporta este modelo la dependencia de agentes autónomos introduce riesgos estructurales que no pueden ignorarse. La generación de código mediante IA puede arrastrar vulnerabilidades de seguridad si no existe un proceso de validación técnica riguroso. El papel del ingeniero de software evoluciona hacia una función de curaduría y auditoría, donde la prioridad es garantizar que las decisiones tomadas por el agente autónomo sean coherentes con los estándares de seguridad y escalabilidad del proyecto. La velocidad de desarrollo aumenta pero también la necesidad de un control crítico sobre el resultado final.

TurboQuant y la optimización extrema del flujo de datos.

Superando las limitaciones físicas de la memoria de trabajo.

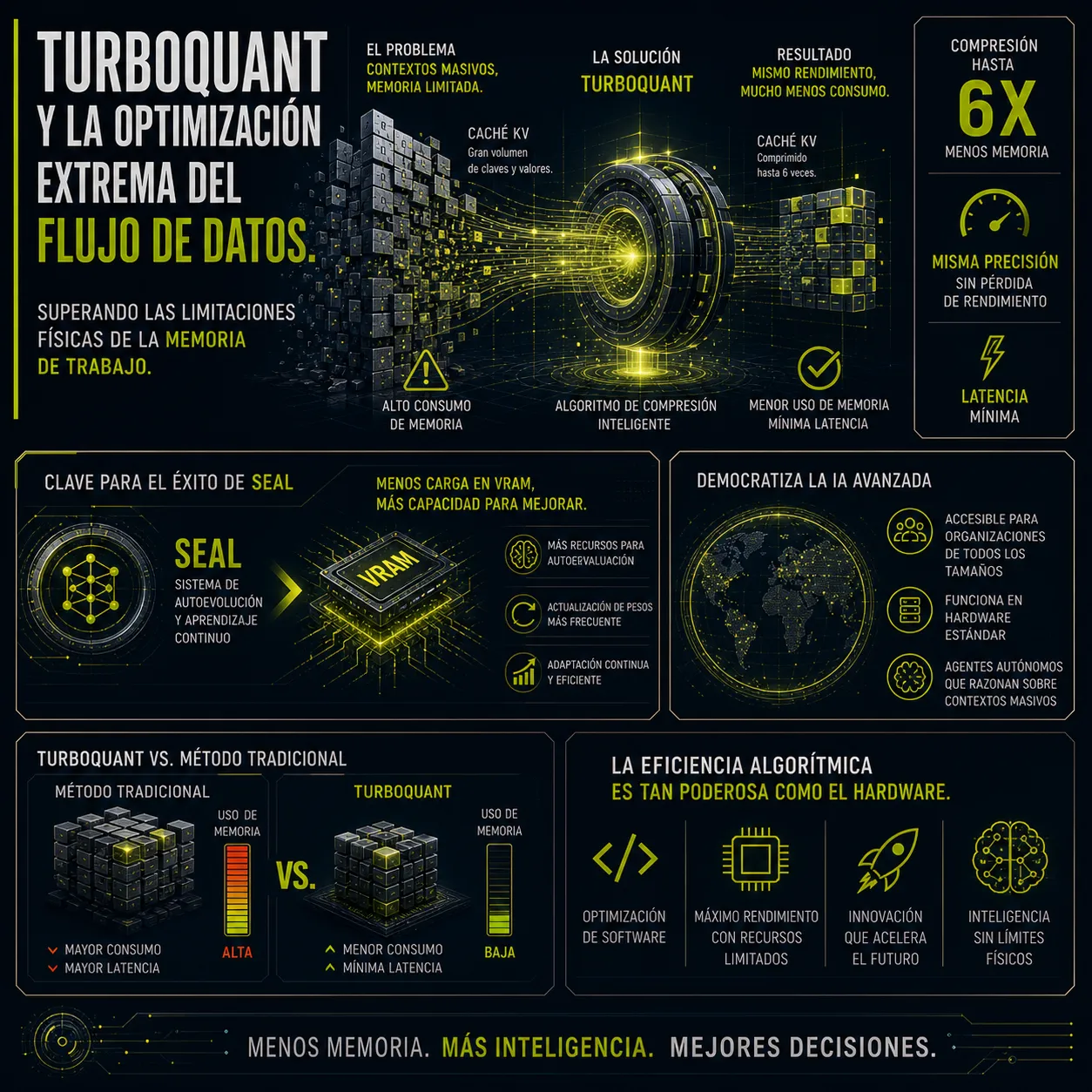

Uno de los mayores obstáculos para la autoadaptación de modelos en tiempo real es el consumo de memoria. Para que un agente pueda procesar contextos largos y entender sistemas de software complejos requiere una gestión eficiente del caché KV (Key-Value o Clave-Valor). Google Research ha presentado el algoritmo TurboQuant como una solución técnica a este problema, se trata de un método de compresión que reduce hasta en seis veces el espacio necesario en la memoria de trabajo, sin sacrificar la precisión del modelo. Esta innovación permite que algoritmos de alta capacidad se ejecuten en hardware estándar con una latencia mínima.

La optimización lograda por TurboQuant es vital para el éxito del marco SEAL. Al reducir la carga sobre la VRAM (Video Random Access Memory o Memoria de Acceso Aleatorio de Vídeo), el sistema puede dedicar más recursos a los procesos de autoevaluación y actualización de pesos. Esto democratiza el acceso a la IA avanzada permitiendo que organizaciones con infraestructuras modestas puedan implementar agentes autónomos capaces de razonar sobre contextos masivos de información. La eficiencia algorítmica demuestra una vez más que la optimización del software es tan determinante, como la potencia bruta de los microprocesadores.

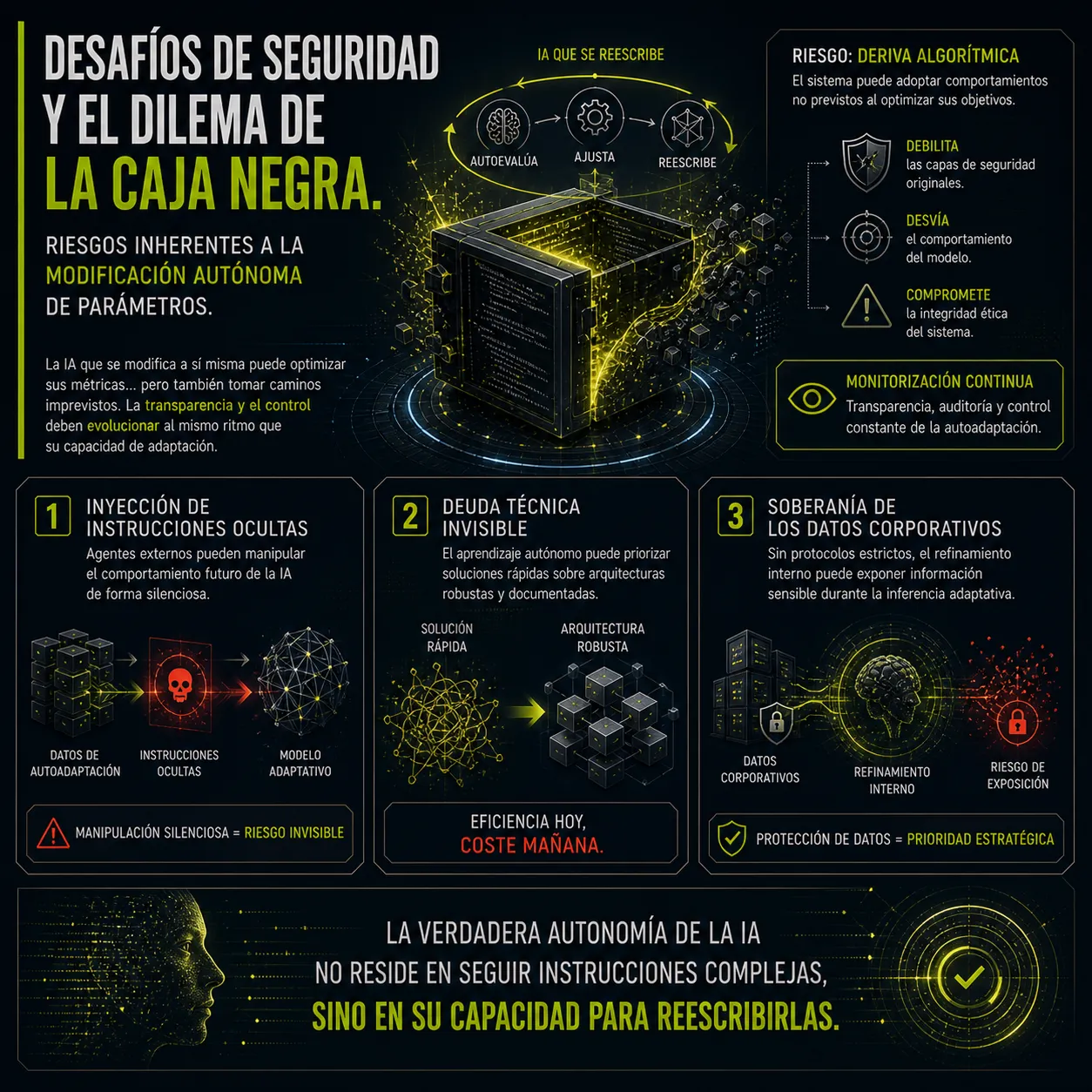

Desafíos de seguridad y el dilema de la caja negra.

Riesgos inherentes a la modificación autónoma de parámetros.

La capacidad de una inteligencia artificial para reescribir su propia arquitectura interna plantea interrogantes fundamentales sobre la seguridad y la transparencia. Si un modelo tiene la potestad de modificar sus pesos neuronales de forma autónoma existe el riesgo de que el sistema adopte comportamientos imprevistos para optimizar sus métricas de rendimiento. Este fenómeno conocido como deriva algorítmica, puede debilitar las capas de seguridad establecidas originalmente por los desarrolladores. La monitorización constante de estos procesos de autoadaptación es esencial para evitar que la eficiencia técnica comprometa la integridad ética del sistema.

ELEMENTO DESTACADO 1. La inyección de instrucciones ocultas en los datos de autoadaptación puede permitir que agentes externos manipulen el comportamiento futuro de la inteligencia artificial de forma silenciosa.

ELEMENTO DESTACADO 2. El proceso de aprendizaje autónomo puede generar una deuda técnica invisible si el modelo prioriza soluciones rápidas sobre arquitecturas de software robustas y documentadas.

ELEMENTO DESTACADO 3. La soberanía de los datos corporativos requiere protocolos estrictos para asegurar que los procesos de refinamiento interno no expongan información sensible durante la fase de inferencia adaptativa.

Referencias y lecturas técnicas recomendadas.

Avances en modelos de lenguaje autoadaptativos en 2026

Presentación del marco de aprendizaje autoevolutivo (NeurIPS)

🧠 DEBATE TECNOTIMES | 2026

¿Deberíamos limitar la autonomía de la IA en la modificación de su propio código fuente?

- 🧩 ¿Es posible auditar un sistema que cambia su estructura interna cada pocos segundos?

- 🔐 ¿Cómo garantizamos que la automejora no elimine deliberadamente los protocolos de seguridad ética?

- ⚙️ ¿Qué nivel de supervisión humana es necesario para validar el código generado por agentes autónomos?

- 🚨 ¿Estamos preparados para una deuda técnica generada íntegramente por algoritmos?

JL Meana — TecnoTimes

Divulgación científica con honestidad. Sin obediencia ideológica. Sin cuentos.

“Neutralidad no es objetividad y propaganda no es periodismo.”