La computación cuántica abandona lentamente el laboratorio.

El verdadero cambio no son más qubits. Es la aparición silenciosa de infraestructura híbrida cuántico-clásica.

Durante años, buena parte de la conversación pública sobre computación cuántica se movió entre dos extremos bastante incómodos. Por un lado, artículos académicos extremadamente especializados que apenas podían leer unas pocas decenas de investigadores. Por otro, titulares delirantes prometiendo máquinas capaces de romper internet, curar enfermedades o destruir la criptografía mundial en cuestión de meses.

Mientras tanto, la realidad técnica avanzaba por otro sitio mucho más aburrido, y mucho más importante también. Herramientas de desarrollo, simuladores, sistemas híbridos, capas de abstracción, gestión de recursos, infraestructura software. Exactamente el tipo de cosas que rara vez aparecen en titulares porque no producen imágenes espectaculares de “ordenadores del futuro” suspendidos dentro de cámaras criogénicas.

Ahí es donde empiezan a encajar proyectos como Origin Pilot y QPanda3 desarrollados por la empresa china Origin Quantum. No representan una revolución inmediata, tampoco el nacimiento de una inteligencia cuántica todopoderosa. Representan algo bastante más tangible, el intento de convertir la computación cuántica en un ecosistema operativo parcialmente industrializable.

Y eso cambia bastante el enfoque.

Porque la pregunta ya no es únicamente cuántos qubits puede fabricar China, la cuestión empieza a desplazarse hacia algo más estratégico. Quién controla el software, quién construye el entorno de desarrollo, quién define los formatos intermedios, quién diseña los sistemas híbridos capaces de coordinar cálculo clásico y cálculo cuántico.

Es decir, quién construye realmente el stack operativo que coordinará todo ese ecosistema híbrido.

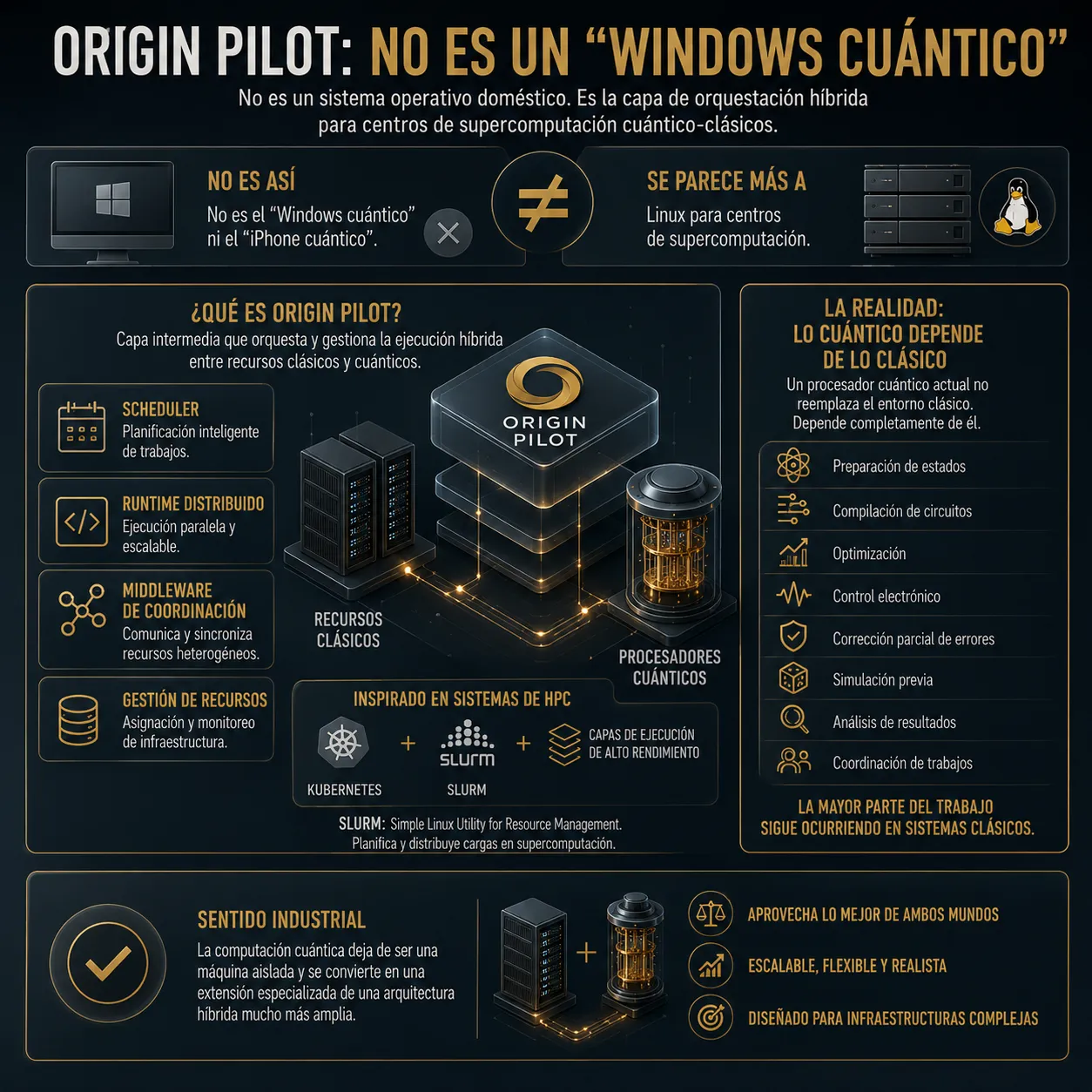

Origin Pilot no es un “Windows cuántico”.

La comparación correcta se parece más a Linux para centros de supercomputación que a un sistema operativo doméstico.

Uno de los problemas habituales del marketing cuántico consiste en intentar explicar sistemas extremadamente especializados utilizando analogías simplistas. Cada vez que aparece una nueva plataforma cuántica, alguien termina llamándola “el Windows de la computación cuántica” o “el iPhone cuántico”. Normalmente eso significa que quien escribe el titular no entiende demasiado bien lo que tiene delante.

Origin Pilot no funciona realmente así.

Lo que Origin Quantum está construyendo se parece mucho más a una capa intermedia de orquestación híbrida. Una combinación de scheduler, runtime distribuido, middleware de coordinación y sistema de gestión de recursos computacionales.

La analogía más razonable no sería Windows. Sería algo más cercano a una mezcla conceptual entre Kubernetes, SLURM y las capas de ejecución utilizadas en computación de alto rendimiento. Es decir, sistemas diseñados para coordinar recursos heterogéneos dentro de infraestructuras complejas.

SLURM significa Simple Linux Utility for Resource Management. Es uno de los sistemas de planificación de tareas más utilizados en supercomputación clásica para distribuir cargas entre nodos de cálculo.

Origin Pilot intenta precisamente eso. Gestionar la ejecución híbrida entre componentes clásicos y procesadores cuánticos todavía extremadamente frágiles.

Porque aquí aparece una realidad incómoda que el marketing evita constantemente. Un procesador cuántico actual no reemplaza un entorno computacional clásico, depende completamente de él. La mayor parte del trabajo sigue ocurriendo fuera del chip cuántico.

La preparación de estados, la compilación de circuitos, la optimización, el control electrónico, la corrección parcial de errores, la simulación previa, el análisis de resultados, la coordinación de trabajos. Todo eso sigue ejecutándose sobre sistemas clásicos convencionales.

Y ahí es donde Origin Pilot empieza a tener sentido industrial.

La computación cuántica deja de verse como una máquina aislada dentro de un laboratorio y empieza a parecer una extensión especializada de una arquitectura híbrida mucho más amplia.

QPanda3 y la realidad menos cinematográfica de programar sistemas cuánticos.

La mayoría del trabajo cuántico actual ocurre sobre simuladores clásicos.

QPanda3 es el entorno de programación cuántica desarrollado por Origin Quantum. y probablemente sea una de las partes más reveladoras de todo este ecosistema.

Porque cuando uno empieza realmente a trabajar con herramientas cuánticas modernas, desaparece bastante rápido la imagen de “máquina milagrosa” que domina buena parte de la divulgación superficial.

Lo primero que descubre cualquier desarrollador es que casi todo empieza en un simulador clásico.

QPanda3 permite construir circuitos cuánticos, definir puertas lógicas, trabajar con estados Bell y estados Greenberger Horne Zeilinger (GHZ), generar código intermedio mediante OriginIR, y ejecutar simulaciones locales usando CPUQVM.

CPUQVM significa Quantum Virtual Machine basada en Unidad Central de Procesamiento. En otras palabras, un simulador ejecutado sobre procesadores clásicos convencionales.

Eso ya desmonta bastante narrativa futurista por sí solo.

Un ejemplo sencillo puede ejecutarse instalando pyqpanda3 mediante un entorno Python local. Después es posible construir un circuito elemental para generar un estado Bell aplicando una puerta Hadamard seguida de una puerta Controlled NOT. El sistema genera entonces el circuito equivalente en OriginIR y ejecuta la simulación mediante CPUQVM.

El resultado parece elegante, pero conviene mantener perspectiva física. Lo que está ocurriendo ahí no es una ejecución sobre un procesador cuántico real refrigerado a temperaturas cercanas al cero absoluto, es una representación matemática simulada dentro de una arquitectura clásica.

Y eso no convierte la herramienta en inútil, al contrario.

La computación cuántica actual se parece bastante a los primeros años de la computación paralela, o de las unidades de procesamiento gráfico antes de la explosión de CUDA. Mucha experimentación ocurre primero sobre simuladores, compiladores y capas intermedias antes de llegar a hardware plenamente operativo.

OriginIR actúa como representación intermedia de circuitos. Funciona como una especie de lenguaje ensamblador especializado para describir operaciones cuánticas de bajo nivel.

Y ahí aparece otra capa bastante importante que rara vez entra en la divulgación general, la compilación cuántica. Un circuito ideal diseñado sobre papel casi nunca puede ejecutarse directamente sobre hardware físico real.

Los compiladores y transpilers deben reorganizar puertas lógicas, optimizar profundidad de circuito, adaptar topologías y mapear qubits lógicos sobre qubits físicos reales cuyas conexiones suelen ser limitadas e imperfectas.

Eso acerca mucho más este ecosistema a herramientas clásicas como LLVM, CUDA o los compiladores utilizados en computación de alto rendimiento. La computación cuántica empieza a parecer menos una curiosidad matemática y más una disciplina de ingeniería computacional especializada.

Ahí empieza a verse algo importante. China no está intentando únicamente fabricar qubit, está construyendo herramientas para desarrollar alrededor de ellos.

La física sigue siendo brutalmente hostil.

La computación cuántica continúa atrapada dentro de límites físicos extremadamente severos.

A veces el discurso público sobre computación cuántica parece olvidar un detalle fundamental. La mecánica cuántica es extraordinariamente útil para describir fenómenos microscópicos, pero también es extraordinariamente inestable cuando se intenta convertir en infraestructura tecnológica escalable.

Los qubits son sistemas extremadamente delicados.

La computación cuántica no lucha solo contra problemas de ingeniería, lucha contra la propia tendencia natural del universo a destruir estados coherentes.

La decoherencia sigue siendo uno de los grandes enemigos físicos del sector. Un estado cuántico puede perder coherencia debido a interacciones mínimas con el entorno, vibraciones, ruido electromagnético, fluctuaciones térmicas, imperfecciones materiales, e incluso errores diminutos en la electrónica de control.

Por eso gran parte de estos sistemas funcionan dentro de complejas infraestructuras criogénicas que consumen enormes cantidades de energía para mantener temperaturas cercanas a milikelvin. No hablamos de “ordenadores futuristas compactos”. Hablamos de instalaciones industriales llenas de refrigeración extrema, instrumentación de microondas y electrónica de precisión.

Y aun así aparecen errores constantemente.

Los problemas de fidelidad continúan siendo enormes. La lectura de estados cuánticos introduce incertidumbre, las operaciones lógicas acumulan ruido, los tiempos de coherencia son limitados, la escalabilidad sigue siendo experimental.

La propia física impone restricciones muy incómodas.

Un estado cuántico puede representarse mediante un vector de estado que describe probabilidades de superposición. Mientras el sistema no se mide, múltiples configuraciones pueden coexistir matemáticamente. El entrelazamiento introduce correlaciones no clásicas entre qubits, pero cuando ocurre una medición, aparece el colapso de la función de onda y el sistema pierde buena parte de esa riqueza probabilística.

Eso genera un problema brutal para la ingeniería real. Mantener coherencia suficiente durante suficiente tiempo para ejecutar operaciones útiles sin que el sistema colapse prematuramente.

La diferencia entre simulación ideal y hardware real sigue siendo gigantesca. Un circuito perfecto en CPUQVM puede degradarse rápidamente cuando se ejecuta sobre un procesador físico afectado por ruido y errores acumulativos.

Y precisamente por eso la mayoría de ventajas cuánticas actuales siguen siendo muy específicas. Optimización concreta, simulación molecular. Algunos problemas probabilísticos muy particulares, investigación criptográfica, y poco más.

No existe reemplazo del cómputo clásico, ni parece cercano.

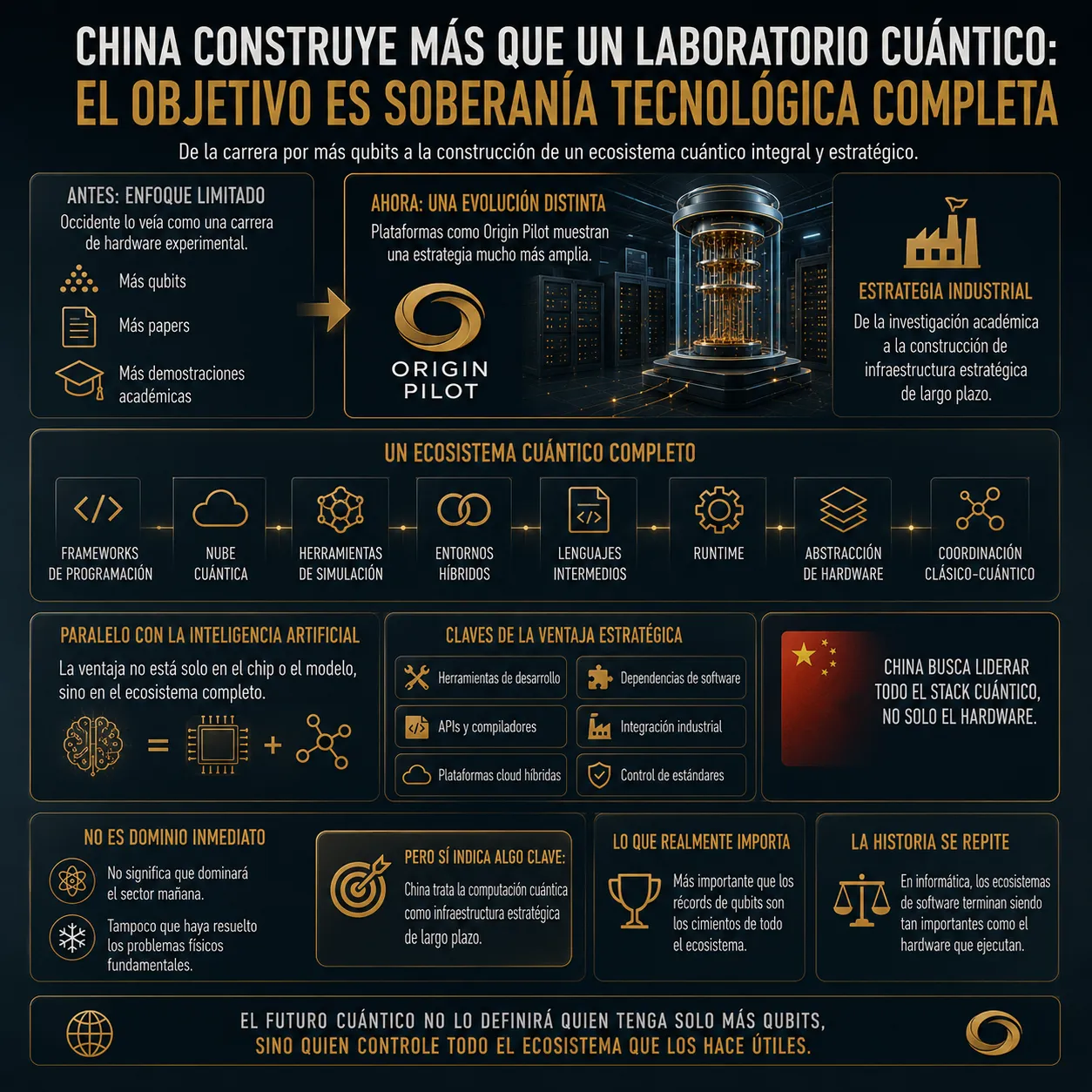

China está construyendo algo más amplio que un laboratorio cuántico.

El objetivo empieza a parecer soberanía tecnológica completa.

Durante bastante tiempo, Occidente interpretó el desarrollo cuántico chino como una carrera centrada únicamente en hardware experimental. Más qubits, más papers, más demostraciones académicas.

Pero plataformas como Origin Pilot muestran una evolución distinta.

China empieza a construir un ecosistema completo. Frameworks de programación, nube cuántica, herramientas de simulación, entornos híbridos, lenguajes intermedios, Runtime, capas de abstracción hardware, plataformas de coordinación entre recursos clásicos y cuánticos.

Eso ya no parece únicamente investigación académica, empieza a parecer estrategia industrial.

Y aquí aparece un paralelismo bastante claro con la inteligencia artificial contemporánea.

La ventaja estratégica rara vez depende solo del modelo o del chip, depende del ecosistema completo. Herramientas de desarrollo, APIs, compiladores, plataformas cloud híbridas, dependencias software, integración industrial, control de estándares.

Exactamente lo que China parece estar intentando construir alrededor de la computación cuántica.

Eso no significa que vaya a dominar el sector mañana, tampoco significa que haya resuelto los problemas físicos fundamentales. Pero sí indica algo relevante, el país está dejando de tratar la computación cuántica como un experimento aislado, y empieza a tratarla como infraestructura estratégica de largo plazo.

Y esa diferencia importa bastante más que muchos récords de qubits anunciados en titulares espectaculares.

Porque la historia de la informática suele repetirse, los ecosistemas software terminan siendo tan importantes como el hardware que ejecutan.

La industria cuántica empieza a copiar algunos vicios de la burbuja de inteligencia artificial.

Mucho titular futurista. Mucha confusión pública. Mucha inflación narrativa.

La computación cuántica atraviesa ahora un momento extraño, hay avances reales, bastante complejos además. Pero alrededor de esos avances empieza a crecer una capa de marketing que recuerda demasiado a ciertos excesos recientes de la inteligencia artificial.

Empiezan a aparecer promesas imposibles, empresas vendiendo “ventajas cuánticas revolucionarias” todavía difíciles de demostrar fuera de escenarios extremadamente concretos. Titulares sobre “internet cuántica global”, declaraciones grandilocuentes sobre el final inmediato del cifrado clásico.

Mientras tanto, gran parte de los experimentos siguen ejecutándose realmente sobre simuladores clásicos.

La diferencia entre demostración controlada y despliegue industrial continúa siendo inmensa, igual que ocurrió con la inteligencia artificial generativa. Existe una tendencia creciente a confundir prototipos especializados con infraestructura madura.

Y eso termina deformando la percepción pública.

Muchos lectores imaginan ordenadores cuánticos sustituyendo portátiles domésticos dentro de pocos años, otros creen que cualquier simulación cuántica implica automáticamente hardware físico cuántico funcionando en tiempo real. Ninguna de las dos cosas se parece demasiado a la situación real.

La mayor parte de la industria todavía está intentando resolver problemas muy básicos de estabilidad física, control de errores y escalabilidad, y aun así, el discurso comercial ya habla como si la revolución estuviera completamente desplegada.

Resulta curioso observar cómo algunos patrones narrativos empiezan a repetirse casi exactamente.

Primero llega una tecnología extremadamente compleja, después aparecen titulares simplificados, más tarde surge inversión especulativa, y finalmente empieza la inflación semántica donde cualquier avance experimental se convierte automáticamente en “el inicio de una nueva era”.

La física suele ser bastante menos impresionable que los departamentos de marketing.

El verdadero cuello de botella sigue siendo físico e industrial. Criogenia, electrónica de control, fidelidad, ruido, consumo energético, materiales, fabricación, coordinación híbrida.

Y precisamente por eso Origin Pilot resulta interesante, no porque venda fantasía futurista, sino porque parece asumir que la computación cuántica necesitará integrarse lentamente dentro de infraestructuras híbridas reales.

El cambio importante no será un ordenador milagroso.

Será la aparición silenciosa de una infraestructura híbrida industrial.

Quizá el mayor error conceptual alrededor de la computación cuántica consista en imaginarla como una sustitución total del cómputo clásico. Una especie de relevo tecnológico instantáneo donde las máquinas actuales desaparecen de repente.

Todo apunta a algo bastante distinto.

La transición probablemente será híbrida, parcial y extremadamente gradual. Sistemas clásicos coordinando aceleradores cuánticos especializados para problemas concretos. Igual que hoy las unidades de procesamiento gráfico trabajan junto a procesadores convencionales dentro de centros de datos modernos.

Por eso herramientas como Origin Pilot terminan siendo más relevantes de lo que parecen a primera vista. No representan magia tecnológica, representan integración operacional.

La computación cuántica empezará a parecer real cuando existan runtimes robustos, compiladores maduros, APIs estables, herramientas de desarrollo utilizables, sistemas de orquestación híbrida y plataformas cloud capaces de integrar cálculo clásico y cuántico sin convertir cada ejecución en un experimento artesanal.

Ese probablemente será el verdadero punto de inflexión.

El día en que aparezca un supuesto “ordenador cuántico mágico” en una presentación espectacular rodeada de humo azul y música épica.

La infraestructura casi nunca llega haciendo ruido.

Referencias relacionadas.

Origin Quantum mantiene documentación pública sobre QPanda3, OriginIR y herramientas de simulación híbrida utilizadas dentro de su ecosistema de desarrollo cuántico.

La documentación técnica de pyQPanda3 permite experimentar localmente con simuladores CPUQVM, circuitos Bell y estados GHZ sobre infraestructura clásica.

IBM y otros actores internacionales también reconocen que la computación cuántica actual depende profundamente de arquitecturas híbridas clásicas.

🧠 DEBATE TECNOTIMES | Infraestructura cuántica y soberanía tecnológica

¿Estamos asistiendo al nacimiento de una nueva infraestructura estratégica o a otra burbuja tecnológica alimentada por narrativa?

- 🧩 ¿La computación cuántica actual está avanzando realmente o seguimos viendo principalmente simulación clásica sofisticada?

- 🔐 ¿Qué implicaciones estratégicas tendrá que China controle parte del ecosistema software y runtime cuántico global?

- ⚙️ ¿Los límites físicos de decoherencia y criogenia impedirán una escalabilidad industrial masiva durante décadas?

- 🚨 ¿Estamos repitiendo con la computación cuántica el mismo patrón de inflación narrativa vivido recientemente con la inteligencia artificial?

JL Meana — TecnoTimes

Divulgación científica con honestidad. Sin obediencia ideológica. Sin cuentos.

“Neutralidad no es objetividad y propaganda no es periodismo.”